2026/03/17(火) [n年前の日記]

#1 [linux] Zorin OS 18を試用

「Windows10のサポート期間が終了したのでLinuxを入れてみる」という記事をいくつか目にしたのだけど、Zorin OSを導入してみる事例が多いような印象を受けた。

Zorin OSは、Debian Linux をベースにして派生した Ubuntu Linux から更に派生したディストリビューション。かなり昔にちょっとだけ試用した記憶もあるけれど、最近はどんな感じなっているのか気になる。少し試用してみようかなと。

環境は Windows11 x64 25H2 + VMware Workstation 17 Pro 17.6.4 build-24832109。

HackGen 2.10.0 もインストール。

Zorin OSは、Debian Linux をベースにして派生した Ubuntu Linux から更に派生したディストリビューション。かなり昔にちょっとだけ試用した記憶もあるけれど、最近はどんな感じなっているのか気になる。少し試用してみようかなと。

環境は Windows11 x64 25H2 + VMware Workstation 17 Pro 17.6.4 build-24832109。

◎ インストール :

公式サイトは以下。

_Zorin OS - Make your computer better.

現行版は18。有償版のProと、無償で利用できるCore版があるらしい。

動作が軽いとされていたLite版もあるらしいのだけど、Lite版は廃止予定らしい。

_Getting Zorin OS Lite - Zorin Help

今回はCore版を試用。Zorin-OS-18-Core-64-bit-r3.iso を入手。

VMware上で仮想PCを新規作成。

インストール自体はすんなりできた。ただ、日本語入力ができない…。

_Zorin OS - Make your computer better.

現行版は18。有償版のProと、無償で利用できるCore版があるらしい。

動作が軽いとされていたLite版もあるらしいのだけど、Lite版は廃止予定らしい。

_Getting Zorin OS Lite - Zorin Help

今回はCore版を試用。Zorin-OS-18-Core-64-bit-r3.iso を入手。

VMware上で仮想PCを新規作成。

- インストール元 : 後でOSをインストール

- ゲストOS : Linux

- バージョン : Ubuntu 64bit

- 他は推奨設定のまま。

インストール自体はすんなりできた。ただ、日本語入力ができない…。

◎ 日本語入力の設定 :

Ubuntu系は ibus ではなく fcitx5 を使うと安定するらしい。

_ZorinOSの日本語入力で詰まったら、ibusを捨ててfcitx5にすると幸せになれる件(実体験) - OS ManiaX

_Zorin OS - 18 - Core GNOME -基本操作 - 日本語入力

上記ページに従って、fcitx5をインストールして、ibusをアンインストール。

ただ、この作業をすると、日本語キーボードが消滅して、英語キーボード(キーボード - 英語(US))とmozcの組み合わせになってしまう。日本語キーボードを追加して、英語キーボードを削除する。

ちょっとよく分からないのが、Japanese (OADG 109A) を選ぶように解説してる記事もあって…。Windows用のキー配置になっているのが OADG 109A ということらしいけど…。

_UbuntuでFcitx5を使うときの日本語入力の不安定な挙動を解消する|Web係りのおじさん

とりあえず、OADG 109A を選んでおこう…。

これで、「半角/全角」または「Ctrl + Space」でIME?が起動して日本語を入力できる状態になった。

しかし、毎回起動するたびに、上のほうに何かメッセージが出てくる…。

_https://extensions.gnome.org/extension/261/kimpanel/

_https://fcitx-im.org/wiki/Using_Fcitx_5_on_Wayland#GNOME

Zorin OS 18 上で、Webブラウザを起動して、上記のURLを開いた。「ここをクリックしてブラウザー拡張機能をインストールしてください. 」と書いてあるので指示に従ってクリック。ブラウザ上に拡張機能がインストールされて、先ほどのページを開き直すとON/OFFを選べるようになった。

また、どこかしらに以下を記述して設定しないといけないらしいが…。

_fcitx5の公式から見る2026年の設定事情

_Zorin OS - 16 - 基本操作 - 日本語入力

どのファイルに書くかで、記述の仕方が変わってくるらしい…。

とりあえず /etc/environment に以下の形で追記してみた。

件のメッセージは出なくなった。

でも、本当に /etc/environment に書いてしまっていいのだろうか。別のファイルのほうが妥当だったりして…?

_ZorinOSの日本語入力で詰まったら、ibusを捨ててfcitx5にすると幸せになれる件(実体験) - OS ManiaX

_Zorin OS - 18 - Core GNOME -基本操作 - 日本語入力

上記ページに従って、fcitx5をインストールして、ibusをアンインストール。

sudo apt install fcitx5 fcitx5-mozc fcitx5-frontend-gtk2 gnome-shell-extensions sudo apt remove ibus mkdir -p ~/.config/autostart cp /usr/share/applications/org.fcitx.Fcitx5.desktop ~/.config/autostart/

ただ、この作業をすると、日本語キーボードが消滅して、英語キーボード(キーボード - 英語(US))とmozcの組み合わせになってしまう。日本語キーボードを追加して、英語キーボードを削除する。

- タスクバー右下のキーボードみたいなアイコンをクリック → 設定。

- 右側で「キーボード - 日本語」を選んで、真ん中の「<」をクリックすれば追加できる。

- 左側で「キーボード - 日本語」を選んで、真ん中の上向き三角をクリックして一番最初に持ってくる。

- 左側で「キーボード - 英語(US)」を選んで、真ん中の「>」をクリックして除去。

ちょっとよく分からないのが、Japanese (OADG 109A) を選ぶように解説してる記事もあって…。Windows用のキー配置になっているのが OADG 109A ということらしいけど…。

_UbuntuでFcitx5を使うときの日本語入力の不安定な挙動を解消する|Web係りのおじさん

とりあえず、OADG 109A を選んでおこう…。

これで、「半角/全角」または「Ctrl + Space」でIME?が起動して日本語を入力できる状態になった。

しかし、毎回起動するたびに、上のほうに何かメッセージが出てくる…。

ウェイランド診断 入力メソッドのポップアップを提供するために、Input Method Panel GNOME Shell Extensions をインストールすることをお勧めします。 https://extensions.gnome.org/extension/261/kimpanel/ そうしないと、GNOME Shell のアクティビティ検索ボックスで入力する時に、入力メソッドのポップアップが表示されないことがあります。 詳細は https://fcitx-im.org/wiki/Using_Fcitx_5_on_Wayland#GNOME を参照してください。

_https://extensions.gnome.org/extension/261/kimpanel/

_https://fcitx-im.org/wiki/Using_Fcitx_5_on_Wayland#GNOME

Zorin OS 18 上で、Webブラウザを起動して、上記のURLを開いた。「ここをクリックしてブラウザー拡張機能をインストールしてください. 」と書いてあるので指示に従ってクリック。ブラウザ上に拡張機能がインストールされて、先ほどのページを開き直すとON/OFFを選べるようになった。

また、どこかしらに以下を記述して設定しないといけないらしいが…。

XMODIFIERS=@im=fcitx QT_IM_MODULE=fcitx GTK_IM_MODULE=fcitx or XMODIFIERS=@im=fcitx QT_IM_MODULES="wayland;fcitx" GTK_IM_MODULE=fcitx

_fcitx5の公式から見る2026年の設定事情

_Zorin OS - 16 - 基本操作 - 日本語入力

どのファイルに書くかで、記述の仕方が変わってくるらしい…。

とりあえず /etc/environment に以下の形で追記してみた。

export LANG="ja_JP.UTF-8" export XMODIFIERS="@im=fcitx" export XMODIFIER="@im=fcitx" export GTK_IM_MODULE=fcitx export QT_IM_MODULE=fcitx export DefaultIMModule=fcitx

件のメッセージは出なくなった。

でも、本当に /etc/environment に書いてしまっていいのだろうか。別のファイルのほうが妥当だったりして…?

◎ NumLockを有効化 :

numlockx をインストールして自動起動するようにすればいいらしい。

_Zorin OS でテンキー(NumLock)をオンにする方法 Kubuntu | shattered-blog.com

スタートメニュー → システムツール → Startup Applications → 追加。コマンドとして numlockx on を指定すればいいらしい。名前や説明は適当に。

ただ、VMware上では期待した結果になってないような…。実機で動かせば違うのかな?

_Ubuntu22.04 起動時にNumlockオン | ろっひー

GNOMEがNumLockの状態を記憶できるように設定することもできるらしい。一度 NumLockキーを叩いて有効にしておけば、再起動後も状態を再現してくれる。

_Zorin OS でテンキー(NumLock)をオンにする方法 Kubuntu | shattered-blog.com

sudo apt install numlockx

スタートメニュー → システムツール → Startup Applications → 追加。コマンドとして numlockx on を指定すればいいらしい。名前や説明は適当に。

ただ、VMware上では期待した結果になってないような…。実機で動かせば違うのかな?

_Ubuntu22.04 起動時にNumlockオン | ろっひー

GNOMEがNumLockの状態を記憶できるように設定することもできるらしい。一度 NumLockキーを叩いて有効にしておけば、再起動後も状態を再現してくれる。

gsettings get org.gnome.desktop.peripherals.keyboard remember-numlock-state gsettings set org.gnome.desktop.peripherals.keyboard remember-numlock-state true

◎ 日本語フォルダを英語にする :

インストール直後は「デスクトップ」「ダウンロード」といった日本語名のフォルダになってしまっている。「Desktop」「Downloads」にしたい。

ログアウトして、再度ログイン。

_Ubuntu: ユーザーディレクトリ名を標準の英語表記に変更する手順

sudo apt-get install xdg-user-dirs-gtk LANG=C xdg-user-dirs-gtk-update

ログアウトして、再度ログイン。

_Ubuntu: ユーザーディレクトリ名を標準の英語表記に変更する手順

◎ フォントを追加 :

sudo apt install fonts-ipafont fonts-ipaexfont fonts-takao fonts-mplus fonts-migmix fonts-mmcedar fonts-umeplus fonts-motoya-l-maruberi fonts-droid-fallback xfonts-100dpi xfonts-75dpi xfonts-base xfonts-scalable xfonts-shinonome xfonts-intl-japanese xfonts-intl-japanese-big xfonts-kaname xfonts-intl-arabic xfonts-intl-asian xfonts-intl-chinese xfonts-intl-chinese-big xfonts-intl-european xfonts-intl-phonetic emacs-intl-fonts fonts-motoya-l-cedar fonts-horai-umefont fonts-ricty-diminished fonts-urw-base35 fonts-liberation fonts-texgyre xfonts-mplus fonts-noto -y

sudo apt install xfonts-naga10 ttf-mscorefonts-installer -y

HackGen 2.10.0 もインストール。

wget https://github.com/yuru7/HackGen/releases/download/v2.10.0/HackGen_v2.10.0.zip wget https://github.com/yuru7/HackGen/releases/download/v2.10.0/HackGen_NF_v2.10.0.zip unzip HackGen_v2.10.0.zip unzip HackGen_NF_v2.10.0.zip mv HackGen_v2.10.0 HackGen mv HackGen_NF_v2.10.0 HackGen_NF rm HackGen/HackGen35* rm HackGen_NF/HackGen35* sudo mv ./HackGen /usr/share/fonts cd HackGen_NF sudo cp *.ttf /usr/share/fonts/HackGen/ fc-cache -fv fc-list : family | grep HackGen

◎ Wineを試用 :

Windows用のアプリをLinux上で動かせるWineが気になったのでインストールしてみた。Zorin OSの場合、zorin-windows-app-support というパッケージをインストールすればいいのかな…?

結構時間がかかった…。

_脱Windows Zorin OSってどんな感じ? Windowsソフトを実行できるか検証 Linux - Qiita

日本語フォントを表示するアプリは文字化けするので、winetricks と cjkfonts をインストールしないといけないらしい。

Windows98時代のドローソフト G.CREW5 をインストールしてみたけれど…。一見動いたように見えたけど、サンプルファイルを開いたらレイアウトが崩れまくり。Wineの設定でWindows98にしてみたところ、表示されてなかったテキストボックス内の文章が表示されるようになって少し改善したけれど、ロゴ等の表示位置はおかしいまま。なかなか厳しいなと…。ただ、アプリによってはちゃんと動きそうな気配はする…。

sudo apt install zorin-windows-app-support

結構時間がかかった…。

_脱Windows Zorin OSってどんな感じ? Windowsソフトを実行できるか検証 Linux - Qiita

日本語フォントを表示するアプリは文字化けするので、winetricks と cjkfonts をインストールしないといけないらしい。

sudo apt install winetricks

export WINEPREFIX="$HOME/.wine" winetricks cjkfonts

Windows98時代のドローソフト G.CREW5 をインストールしてみたけれど…。一見動いたように見えたけど、サンプルファイルを開いたらレイアウトが崩れまくり。Wineの設定でWindows98にしてみたところ、表示されてなかったテキストボックス内の文章が表示されるようになって少し改善したけれど、ロゴ等の表示位置はおかしいまま。なかなか厳しいなと…。ただ、アプリによってはちゃんと動きそうな気配はする…。

◎ 雑感 :

見た目がオシャレなディストリビューションだなと…。

ただ、自分は普段 Ubuntu Linux や Debian Linux も使っているので、機能面で Zorin OS ならでは、といった部分を感じられず…。Ubuntu や Debian でええやん、という感想になってしまって…。

インストール直後から日本語入力ができない点もちょっと気になる。このあたり、英語圏で利用されることを前提にして作られてそうな気配も…。

でも、あちこちがオシャレなんだよなあ…。ここまでオシャレだと「Windowsじゃなくても、これでいいじゃないか」という気分になれそうではある…。

ただ、自分は普段 Ubuntu Linux や Debian Linux も使っているので、機能面で Zorin OS ならでは、といった部分を感じられず…。Ubuntu や Debian でええやん、という感想になってしまって…。

インストール直後から日本語入力ができない点もちょっと気になる。このあたり、英語圏で利用されることを前提にして作られてそうな気配も…。

でも、あちこちがオシャレなんだよなあ…。ここまでオシャレだと「Windowsじゃなくても、これでいいじゃないか」という気分になれそうではある…。

[ ツッコむ ]

#2 [anime] 「Song of the Sea」を視聴

Eテレで放送されていた版を録画していたので視聴。アイルランドの手描きアニメ映画。トム・ムーア監督作品。アイルランドのアニメスタジオ、Cartoon Saloon による制作。

一部のカットは Moho を使って作られている、という宣伝記事を頻繁に目にしていたので気になっていたのだけど…。なるほど、こういうアニメだったのか…。実に独特な絵柄/スタイルでイイ感じ。おそらくはアイルランドの民話を基にした設定やストーリーなのだろうけど、それもまた独特な雰囲気に繋がってる印象を受けた。色々な賞を取ったとか、アカデミー賞にノミネートされていたという話にも納得。この出来なら当然の流れというか…。

主に、フランス発のアニメ制作ソフト TVPaint で作られていたらしい。TVPaint を使えばこういったアニメを作れますよという実績になりそうだなと…。ただ、ググってみたら TVPaint ってお値段が高い…。30万円ぐらいする…。サブスクリプションではなく買い切りタイプ/永続ライセンスなのでそのあたりは安心かもしれないけれど。

監督さんのインタビュー記事を目にしたけれど、スタジオジブリの「となりのトトロ」「千と千尋の神隠し」に影響を受けたそうで。アニミズムがどうとか…。たしかに妖精云々のあたりは共通点がありそうだなと…。ジブリ作品に登場する各キャラは、日本国内では妖精とは言われてないけれど、欧米ではどれも妖精扱いなんだろうな。

メイキング映像を眺めた限りでは、従来の手描きアニメと同様に、原画も動画も線で描いて仕上げていく作り方だったようで…。CGソフトを活用して静止画を動画にするとか、あるいはパーツ分けしてカットアウトで動かすソレを期待してたので、その点は少し残念。やっぱりコツコツ描かないとこういうアニメは作れないのだなあ…。 _なんとかインチキできんのか。

一部のカットは Moho を使って作られている、という宣伝記事を頻繁に目にしていたので気になっていたのだけど…。なるほど、こういうアニメだったのか…。実に独特な絵柄/スタイルでイイ感じ。おそらくはアイルランドの民話を基にした設定やストーリーなのだろうけど、それもまた独特な雰囲気に繋がってる印象を受けた。色々な賞を取ったとか、アカデミー賞にノミネートされていたという話にも納得。この出来なら当然の流れというか…。

主に、フランス発のアニメ制作ソフト TVPaint で作られていたらしい。TVPaint を使えばこういったアニメを作れますよという実績になりそうだなと…。ただ、ググってみたら TVPaint ってお値段が高い…。30万円ぐらいする…。サブスクリプションではなく買い切りタイプ/永続ライセンスなのでそのあたりは安心かもしれないけれど。

監督さんのインタビュー記事を目にしたけれど、スタジオジブリの「となりのトトロ」「千と千尋の神隠し」に影響を受けたそうで。アニミズムがどうとか…。たしかに妖精云々のあたりは共通点がありそうだなと…。ジブリ作品に登場する各キャラは、日本国内では妖精とは言われてないけれど、欧米ではどれも妖精扱いなんだろうな。

メイキング映像を眺めた限りでは、従来の手描きアニメと同様に、原画も動画も線で描いて仕上げていく作り方だったようで…。CGソフトを活用して静止画を動画にするとか、あるいはパーツ分けしてカットアウトで動かすソレを期待してたので、その点は少し残念。やっぱりコツコツ描かないとこういうアニメは作れないのだなあ…。 _なんとかインチキできんのか。

[ ツッコむ ]

2025/03/17(月) [n年前の日記]

#1 [nitijyou] ラジオを物色中

ポータブルラジオを物色中。

◎ ポータブルラジオが届いた :

昨日、親父さんがヨドバシカメラに注文していたポータブルラジオが届いたのでメモしておく。

_AudioCommスタミナハンディラジオ 品番03-5530|株式会社オーム電機

- オーム電機 AudioComm RAD-H260N スタミナハンディラジオ 品番 03-5530。税込1,610円。単3電池 x 2本。乾電池持続時間: スピーカー使用時 AM受信 約210h / FM受信 約200h、イヤホン使用時 AM受信 約450h / FM受信 約420h。幅 122.5 x 高さ 71 x 奥行 35mm。ストラップ付。

_AudioCommスタミナハンディラジオ 品番03-5530|株式会社オーム電機

◎ 購入した経緯 :

お袋さんが常用してる Panasonic RF-P55 が、音量を上げると音が割れる状態になっているので、その代替品として、オーム電機 AudioComm RAD-H260N を購入した。

*1

ただ、新品のラジオが届いたものだから、親父さんが自分で使いたがってしまって…。それだとお袋さんが相変わらず音が割れたラジオを聴いてしまう。代替品を購入した意味が無くなる。

親父さんには、自分が持っていた オーム電機 AudioComm RAD-F127N-H を渡して、しばらくソレを使ってもらうことにした。

しかし、1日も経たずに「このラジオはダメだ。音が割れる」と親父さんから苦情が…。単4電池 x 2本で動くぐらいに本体が小さいラジオなので、使ってるスピーカも小さいから、音量を上げると音が割れて当然かも…。それでも親父さんが今まで使っていた手帳型ラジオ、National pepper R-022 よりはマシな音のはずなのだけど。手帳型ラジオは薄いから、スピーカも薄型。ちょっと音量を上げるとビリビリとした音になってしまう。

とりあえず、お袋さんが今まで使ってた RF-P55 を親父さんに渡しておいた。しかしソレも音が割れるし…。

そんなわけで、音量を上げても音が割れない感じのラジオは無いものかと探し始めてしまった。

まずは大きいスピーカがついてそうな製品を探してみたけれど、単一電池 x 3本を使うタイプだったりするようで…。スピーカが大きければ電力消費も大きくなりそうだし、単一電池になるのも仕方ないのかな…。

いっそコンセントに差して使えるラジオはどうか…。でも、手帳型ラジオを使っていた親父さんが、そんな巨大(?)なラジオで満足するだろうか…。

コンパクトさと、スピーカの音質、やはり両立しないだろうな…。

ただ、新品のラジオが届いたものだから、親父さんが自分で使いたがってしまって…。それだとお袋さんが相変わらず音が割れたラジオを聴いてしまう。代替品を購入した意味が無くなる。

親父さんには、自分が持っていた オーム電機 AudioComm RAD-F127N-H を渡して、しばらくソレを使ってもらうことにした。

しかし、1日も経たずに「このラジオはダメだ。音が割れる」と親父さんから苦情が…。単4電池 x 2本で動くぐらいに本体が小さいラジオなので、使ってるスピーカも小さいから、音量を上げると音が割れて当然かも…。それでも親父さんが今まで使っていた手帳型ラジオ、National pepper R-022 よりはマシな音のはずなのだけど。手帳型ラジオは薄いから、スピーカも薄型。ちょっと音量を上げるとビリビリとした音になってしまう。

とりあえず、お袋さんが今まで使ってた RF-P55 を親父さんに渡しておいた。しかしソレも音が割れるし…。

そんなわけで、音量を上げても音が割れない感じのラジオは無いものかと探し始めてしまった。

まずは大きいスピーカがついてそうな製品を探してみたけれど、単一電池 x 3本を使うタイプだったりするようで…。スピーカが大きければ電力消費も大きくなりそうだし、単一電池になるのも仕方ないのかな…。

いっそコンセントに差して使えるラジオはどうか…。でも、手帳型ラジオを使っていた親父さんが、そんな巨大(?)なラジオで満足するだろうか…。

コンパクトさと、スピーカの音質、やはり両立しないだろうな…。

*1: お袋さんは RF-P55を何度も床に落としてるとのことなので、おそらくだけどケースにスピーカを固定するプラスチック部分が折れてしまって、スピーカが固定されてない状態になっているのではないかと…。だから音量を上げるとスピーカがビリビリと震えてしまうのではないか。以前電池ケースを開けたら、中からプラスチックの欠片が落ちてきたし。

[ ツッコむ ]

2024/03/17(日) [n年前の日記]

#1 [prog] C言語とOpenGLで疑似3D道路の描画実験中。その4

Windows10 x64 22H2上で、C言語 + OpenGL 1.1 + glfw を使って実験中。疑似3D道路を描画してみたい。

C言語で書いた疑似3D道路を描画するプログラムを、省電力CPUを載せてるサブPC上で動かしてみた。

メインPC (AMD Ryzen 5 5600X + GeForcet GTX 1060 6GB) で動かすと60FPSで描画できるプログラムなのだけど、サブPCで動かしてみたら、30 - 37FPS しか出なかった。厳しい…。CPU使用率は18%とかその程度だけど、GPUの使用率は85%以上になってる。内蔵GPUのスペックの低さが足を引っ張てるようだなと…。

ビルボードを一切描画せず、道路と背景だけを描画するプログラムを動かしたら滑らかに動いてしまったので、大量のビルボード群の描画で一気にGPU負荷がかかってる模様。大量と言っても、描画してる道路のセグメントが200個程度で、1セグメントにつき1枚だけビルボードを描画している状態だから、200枚より少ないのだけど。描画面積が厳しいのかな…。

とは言え、1920x1200の解像度でこのぐらい描画できてるのだからマシなほうかも。HSP + CPUのソフトウェア処理で描画させると、ベロン…ベロン…な感じのフレームレートになるし。さすがOpenGL。ハードウェア描画って速いなと…。

とりあえず、1フレームでかかった時間を、カメラの移動速度に反映させてみた。画面の書き換えはガタガタしてるけど、移動速度はさほど不自然ではなくなった。

C言語で書いた疑似3D道路を描画するプログラムを、省電力CPUを載せてるサブPC上で動かしてみた。

- CPU : AMD Athlon 5350 (2GHz, 4C/4T, TDP 25W)

- GPU : 内蔵GPU (Radeon R3, GCN)

- RAM : 4GB

- OS : Windows10 x64 22H2

- 画面解像度 : 1920 x 1200。

メインPC (AMD Ryzen 5 5600X + GeForcet GTX 1060 6GB) で動かすと60FPSで描画できるプログラムなのだけど、サブPCで動かしてみたら、30 - 37FPS しか出なかった。厳しい…。CPU使用率は18%とかその程度だけど、GPUの使用率は85%以上になってる。内蔵GPUのスペックの低さが足を引っ張てるようだなと…。

ビルボードを一切描画せず、道路と背景だけを描画するプログラムを動かしたら滑らかに動いてしまったので、大量のビルボード群の描画で一気にGPU負荷がかかってる模様。大量と言っても、描画してる道路のセグメントが200個程度で、1セグメントにつき1枚だけビルボードを描画している状態だから、200枚より少ないのだけど。描画面積が厳しいのかな…。

とは言え、1920x1200の解像度でこのぐらい描画できてるのだからマシなほうかも。HSP + CPUのソフトウェア処理で描画させると、ベロン…ベロン…な感じのフレームレートになるし。さすがOpenGL。ハードウェア描画って速いなと…。

とりあえず、1フレームでかかった時間を、カメラの移動速度に反映させてみた。画面の書き換えはガタガタしてるけど、移動速度はさほど不自然ではなくなった。

[ ツッコむ ]

#2 [movie] 「最強のふたり」を視聴

BS12で放送されてたので途中から視聴。実話を元にした実写のフランス映画。

_Wikipedia

の記述によると「バディコメディドラマ映画」に区分されるらしい。

恥ずかしながらタイトルすら知らなかった映画なので見なくてもいいかなと思ってたけど、たまたま見始めたら目が離せなくなった。失敗した。最初から見ておくのだった。これは結構、いや、かなり面白い映画なのでは…。と言ってもド派手なアクションシーンがあるわけでもなく、ゴイスなVFXがあるわけでもなく、観客が「泣けました!」とインタビュー映像で答える系でもなく、淡々と日常が過ぎていくだけの映画なのだけど。眺めているだけで色々と学びがあったというか…。

ぶっちゃけ、少女漫画等で飽きるほど見てきた「フッ おもしれー女」のソレを、おっさんと青年に置き換えたらこうなりますよーと言えそうな内容とも思ったのだけど。キャラ設定が違うだけでここまで印象が変わるんかと目から鱗が落ちた。こういうアレンジは他でも応用できるのではなかろうか…。「ハイハイ。ありがちありがち」と思ってしまうネタも、ココを変えたらガラリと変わるよね、みたいなことってまだまだありそうだなと…。

また、異文化交流を見せてくれる作品はやっぱり強いなと。キャラを異世界に連れて行かなくても、こうして現実世界を舞台にして異文化交流の様子を見せることができるのだよな…。この映画は人種の違いや階級差を盛り込むことで異文化を強調していたけれど、そこまで設定しなくても、どの場所にも、どのコミュニティにも、特有の文化は存在しているはずで、そこにフォーカスを当ててみるのはアリかもしれんと思えてきた。

そして、映画はコントラストが肝なのだなと改めて認識。いや、白人と黒人を並べたら見た目として、みたいな話ではなく…。育ちが違う者同士を並べても、置かれてる状況が違う者を並べても、年齢が違う者を並べても、そこにコントラストは生まれるわけで。

絶えずユーモアも盛り込むことも重要だなと…。相手の発言にジョークで、あるいは皮肉で返す会話をずっと心掛けてる脚本のように感じた。本来暗くなってしまう状況でも、台詞にユーモアが織り交ぜてあると印象が全然違う。つくづく、脚本って大事…。

途中からの視聴ではあるけれど、見ておいて良かった。この映画はとても勉強になった。もっとも、期待して視聴すると肩透かしになりそうな映画っぽい気もする…。再度書いておくけど「泣けました!」と言い出す系の映画ではないし…。そもそもフランス映画だし。

この映画、色んな国でリメイクされたらしいけど、それも納得。

恥ずかしながらタイトルすら知らなかった映画なので見なくてもいいかなと思ってたけど、たまたま見始めたら目が離せなくなった。失敗した。最初から見ておくのだった。これは結構、いや、かなり面白い映画なのでは…。と言ってもド派手なアクションシーンがあるわけでもなく、ゴイスなVFXがあるわけでもなく、観客が「泣けました!」とインタビュー映像で答える系でもなく、淡々と日常が過ぎていくだけの映画なのだけど。眺めているだけで色々と学びがあったというか…。

ぶっちゃけ、少女漫画等で飽きるほど見てきた「フッ おもしれー女」のソレを、おっさんと青年に置き換えたらこうなりますよーと言えそうな内容とも思ったのだけど。キャラ設定が違うだけでここまで印象が変わるんかと目から鱗が落ちた。こういうアレンジは他でも応用できるのではなかろうか…。「ハイハイ。ありがちありがち」と思ってしまうネタも、ココを変えたらガラリと変わるよね、みたいなことってまだまだありそうだなと…。

また、異文化交流を見せてくれる作品はやっぱり強いなと。キャラを異世界に連れて行かなくても、こうして現実世界を舞台にして異文化交流の様子を見せることができるのだよな…。この映画は人種の違いや階級差を盛り込むことで異文化を強調していたけれど、そこまで設定しなくても、どの場所にも、どのコミュニティにも、特有の文化は存在しているはずで、そこにフォーカスを当ててみるのはアリかもしれんと思えてきた。

そして、映画はコントラストが肝なのだなと改めて認識。いや、白人と黒人を並べたら見た目として、みたいな話ではなく…。育ちが違う者同士を並べても、置かれてる状況が違う者を並べても、年齢が違う者を並べても、そこにコントラストは生まれるわけで。

絶えずユーモアも盛り込むことも重要だなと…。相手の発言にジョークで、あるいは皮肉で返す会話をずっと心掛けてる脚本のように感じた。本来暗くなってしまう状況でも、台詞にユーモアが織り交ぜてあると印象が全然違う。つくづく、脚本って大事…。

途中からの視聴ではあるけれど、見ておいて良かった。この映画はとても勉強になった。もっとも、期待して視聴すると肩透かしになりそうな映画っぽい気もする…。再度書いておくけど「泣けました!」と言い出す系の映画ではないし…。そもそもフランス映画だし。

この映画、色んな国でリメイクされたらしいけど、それも納得。

[ ツッコむ ]

2023/03/17(金) [n年前の日記]

#1 [anime] 「ジャンプSL」とはなんぞや

アニメ関係の記事を眺めていたら、「ジャンプスライド」なる言葉が目に入った。ソレって一体なんぞや。

_「もはや『ジャンプスライド』の素材の作り方がわかる人がいなくなった印象... / Twitter

_「ジャンプスライドの素材は作れるけど、ジャンプスライドでお願いしますって演出さんに言われること自体がめったにない... / Twitter

_【アニメ撮影】デジタル撮影でジャンプ・SLのメリットはあるのか? - Togetter

_【アニメ撮影】ジャンプSLは海外出ししても大丈夫なのか? - Togetter

ググってみたところ、「ジャンプSL」「ジャンプタップSL」「ジャンプスライド」と呼ばれている技で…。アニメキャラを歩かせたり走らせたりする時に使える、見た目を改善できる技の一つ、らしい。

例えば、左から右に、画面を横切るようにキャラが歩いていくカットでは、左から右まで移動する様子を全部動画で描き起こしたら大変なことになるから…。2歩分だけ歩くループアニメ(ループ動画?)を作って、撮影時に位置を少しずつ変えて、ずっと歩き続けているように見せたりするそうで。そういう時に使えるテクニックの一つが「ジャンプSL」なのだとか。

ちなみに、宮崎駿監督が「アルプスの少女ハイジ」を作っていた頃に発明したらしい、という話も見かけた。ホントかどうかは知らんけど。 *1

せっかく知ったので、一応メモしておこうかなと。もし間違ったことを書いてたらその時はツッコミよろしくなのです。

余談。「ジャンプスライド」でググるとゲームのアクションの話ばかりが出てくる…。

_「もはや『ジャンプスライド』の素材の作り方がわかる人がいなくなった印象... / Twitter

_「ジャンプスライドの素材は作れるけど、ジャンプスライドでお願いしますって演出さんに言われること自体がめったにない... / Twitter

_【アニメ撮影】デジタル撮影でジャンプ・SLのメリットはあるのか? - Togetter

_【アニメ撮影】ジャンプSLは海外出ししても大丈夫なのか? - Togetter

ググってみたところ、「ジャンプSL」「ジャンプタップSL」「ジャンプスライド」と呼ばれている技で…。アニメキャラを歩かせたり走らせたりする時に使える、見た目を改善できる技の一つ、らしい。

例えば、左から右に、画面を横切るようにキャラが歩いていくカットでは、左から右まで移動する様子を全部動画で描き起こしたら大変なことになるから…。2歩分だけ歩くループアニメ(ループ動画?)を作って、撮影時に位置を少しずつ変えて、ずっと歩き続けているように見せたりするそうで。そういう時に使えるテクニックの一つが「ジャンプSL」なのだとか。

ちなみに、宮崎駿監督が「アルプスの少女ハイジ」を作っていた頃に発明したらしい、という話も見かけた。ホントかどうかは知らんけど。 *1

せっかく知ったので、一応メモしておこうかなと。もし間違ったことを書いてたらその時はツッコミよろしくなのです。

余談。「ジャンプスライド」でググるとゲームのアクションの話ばかりが出てくる…。

◎ 「SL」について :

「ジャンプSL」についてメモする前に、只の「SL(スライド)」についてメモしておく。

要するに、以下のような、2歩分のループアニメを作って…。

上記のループアニメを、撮影処理時に、以下のように動かしてやれば、ずっと歩いてるように見えるよね、と。これが「SL(スライド)」。らしい。たぶん。

まあ、見た通り、分かりやすいなと…。しかし、この方法は、足が地面の上を滑ってるように見えてしまう問題があるそうで。 *2

そこで考え出されたのが、「ジャンプSL」「ジャンプタップSL」「ジャンプスライド」と呼ばれるソレなのだとか。

要するに、以下のような、2歩分のループアニメを作って…。

上記のループアニメを、撮影処理時に、以下のように動かしてやれば、ずっと歩いてるように見えるよね、と。これが「SL(スライド)」。らしい。たぶん。

まあ、見た通り、分かりやすいなと…。しかし、この方法は、足が地面の上を滑ってるように見えてしまう問題があるそうで。 *2

そこで考え出されたのが、「ジャンプSL」「ジャンプタップSL」「ジャンプスライド」と呼ばれるソレなのだとか。

◎ 「ジャンプSL」について :

「ジャンプSL」は、以下のようなループアニメを作る。2歩分歩く動画を作るのは「SL」と同じだけど、実際に動画上で、足が動いた分を移動させてしまう。

そして、撮影時は、以下のように位置をずらす。

こういう作り方をすることで、足がちゃんと地面についた状態で歩いてるように見せることができるのだとか。いやまあ、上記の動画は、自分のようなド素人が作ったサンプルなので、その効果が全然出てないと思うけど…。プロのアニメーターさんが描けばバッチリな結果になるのだろうなと。 *3

ただ、この「ジャンプSL」、海外のアニメスタジオに色々と頼ってる現在では、ほとんどの場面で使えないという話も…。

まあ、視聴者側も、足が滑ってるか滑ってないかなんて気にしてないだろうし…。どうせアイツラ、キャラの首から上しか見てねえよ、SLで十分やろ、という気もしますな…。

そして、撮影時は、以下のように位置をずらす。

こういう作り方をすることで、足がちゃんと地面についた状態で歩いてるように見せることができるのだとか。いやまあ、上記の動画は、自分のようなド素人が作ったサンプルなので、その効果が全然出てないと思うけど…。プロのアニメーターさんが描けばバッチリな結果になるのだろうなと。 *3

ただ、この「ジャンプSL」、海外のアニメスタジオに色々と頼ってる現在では、ほとんどの場面で使えないという話も…。

- 海外のアニメスタジオ/動画マンに発注すると、珍妙な中割りになって帰ってくる。

- 国内のアニメスタジオ/動画マンでも、やり方を知ってる人と知らない人が居る。

- 社内の動画マンに説明しても分かってもらえなかった事例アリ。

- 「動画ミスや撮影ミスが起きやすいのでジャンプSLは禁止にしてください」と釘を刺されちゃった事例アリ。

まあ、視聴者側も、足が滑ってるか滑ってないかなんて気にしてないだろうし…。どうせアイツラ、キャラの首から上しか見てねえよ、SLで十分やろ、という気もしますな…。

◎ TVゲームにも関係しそう :

ところで。この「SL」と「ジャンプSL」、TVゲームにも関係してくる話なのだろうなと。

と言うのも、昔、Unityというゲームエンジンを少し触っていた際、サンプルのモーションデータを眺めて「アレ?」と思ったことがあって。その場で走り続ける「SL」的なループモーションと、一定距離を実際に移動して走る「ジャンプSL」的なループモーション、その2つが混在していて、「コレって一体どっちを使えばいいんだ?」と悩んだ記憶が…。

プログラマーからすると「SL」方式のほうが扱いは楽。後から移動速度を変えてくれと言われても数値を弄るだけで済んじゃうし。 *4 でも、見た目は不自然だろうなと。やはり、地面の上を足が滑っているように見えちゃうことが多いはず。

となると、「ジャンプSL」的に、足が動いた分実際に移動するようなモーションを作ったほうが良いだろうけど…。でも、それはそれで問題が色々ありそう…。

でもまあ、最初のバーチャファイターですら、モーション再生中にダメージを受けても、ちゃんとそれらしい位置でダメージモーション出してるし…。妙な位置まで急に戻ってダメージモーション再生したりしないですよね…。どんなゲームもフツーにどうにかして解決してるよな…。たぶん。

2Dゲームの頃も、基本的には「SL」で動かしつつ、一時的に「ジャンプSL」が使われていたのではないかと想像したりもして。例えば悪魔城シリーズでプレイヤーキャラが階段を登る時は、足の位置と階段の位置がずれてしまうと見た目がおかしくなりそうだし、そういう時だけはジャンプSL的なアニメパターンの持ち方になっていたのでは…。いや、作ったことないから分からんですけど。あくまで想像ですけど。 *5

というか、たぶん2D格ゲーなども、どこかしらの場面でジャンプSL的なことをしないと作れない気がする。ケースバイケースでアニメパターンの持ち方を考えていかないといかんのだろうな…。

と言うのも、昔、Unityというゲームエンジンを少し触っていた際、サンプルのモーションデータを眺めて「アレ?」と思ったことがあって。その場で走り続ける「SL」的なループモーションと、一定距離を実際に移動して走る「ジャンプSL」的なループモーション、その2つが混在していて、「コレって一体どっちを使えばいいんだ?」と悩んだ記憶が…。

プログラマーからすると「SL」方式のほうが扱いは楽。後から移動速度を変えてくれと言われても数値を弄るだけで済んじゃうし。 *4 でも、見た目は不自然だろうなと。やはり、地面の上を足が滑っているように見えちゃうことが多いはず。

となると、「ジャンプSL」的に、足が動いた分実際に移動するようなモーションを作ったほうが良いだろうけど…。でも、それはそれで問題が色々ありそう…。

- 移動速度を変えたい時は、モーションを作ったアニメーターさんまでわざわざ戻って修正作業をお願いするの?

- アタリ判定はどうなるの? アタリ範囲がずれたりしない?

- 移動中にダメージを受けたらどうなるの? どの位置でダメージモーションが再生されるの?

- 複雑な地形があったらどういう動きになるの?

でもまあ、最初のバーチャファイターですら、モーション再生中にダメージを受けても、ちゃんとそれらしい位置でダメージモーション出してるし…。妙な位置まで急に戻ってダメージモーション再生したりしないですよね…。どんなゲームもフツーにどうにかして解決してるよな…。たぶん。

2Dゲームの頃も、基本的には「SL」で動かしつつ、一時的に「ジャンプSL」が使われていたのではないかと想像したりもして。例えば悪魔城シリーズでプレイヤーキャラが階段を登る時は、足の位置と階段の位置がずれてしまうと見た目がおかしくなりそうだし、そういう時だけはジャンプSL的なアニメパターンの持ち方になっていたのでは…。いや、作ったことないから分からんですけど。あくまで想像ですけど。 *5

というか、たぶん2D格ゲーなども、どこかしらの場面でジャンプSL的なことをしないと作れない気がする。ケースバイケースでアニメパターンの持ち方を考えていかないといかんのだろうな…。

◎ 2023/03/18追記 :

APNG画像を貼ってたけど、アニメgif画像に変更しておいた。これでどんなブラウザでもアニメしてるように見えるはず。

*1: 昔の東映動画で、先人達が生み出した技の数々は、何故か「宮崎駿が初めてやった」と言われてしまうことがチラホラあるので、そういう話は疑ってかからないとマズいよなと。宮崎駿監督にだって、先輩や同世代が居るのだし、皆で喧々諤々しながら次第に固めていったアレコレが多々あるはず。その手柄を宮崎駿監督が全部持っていくのは、それはちょっとどうかなあ、と。もちろん、「誰が発明したのか今となっては分からんのだけど、その普及に宮崎駿監督が大きく貢献した」「宮崎駿監督が広めてくれた」という言い方なら全然OKだよなと思うのですが。

*2: 更にフィルム撮影時代は、セルを固定してるタップの位置を少しずつ動かしつつ、撮影するセルを変えていく作業になるので、撮影作業ミスが起きやすいという問題もあったらしい。

*3: 加えてフィルム撮影時代は、セルの交換回数は「SL」と同じだけど、タップ位置を動かす回数が激減できるので、ミスが起きにくくなるメリットもあったらしい。

*4: ゲームエンジンを使って作ってるなら、別の作業者でも移動速度を容易に変更できるように、あらかじめパラメータ入力欄を用意しておくだろうなと…。そのくらい、扱いが楽。

*5: 気になってその手の動画をコマ送りしてみたら、PCエンジン版だけ完璧に足と階段の位置が合っていた。それ以外の版、ファミコン、スーパーファミコン、メガドラ版は、足と階段の位置がめっちゃずれてた…。自分の中ではPCエンジン版の印象が強く残ってたんだな…。ちなみにAC版は、階段上で雑に瞬間移動してるように見えるけど、実はちゃんと足と階段の位置を合わせてあった。

*2: 更にフィルム撮影時代は、セルを固定してるタップの位置を少しずつ動かしつつ、撮影するセルを変えていく作業になるので、撮影作業ミスが起きやすいという問題もあったらしい。

*3: 加えてフィルム撮影時代は、セルの交換回数は「SL」と同じだけど、タップ位置を動かす回数が激減できるので、ミスが起きにくくなるメリットもあったらしい。

*4: ゲームエンジンを使って作ってるなら、別の作業者でも移動速度を容易に変更できるように、あらかじめパラメータ入力欄を用意しておくだろうなと…。そのくらい、扱いが楽。

*5: 気になってその手の動画をコマ送りしてみたら、PCエンジン版だけ完璧に足と階段の位置が合っていた。それ以外の版、ファミコン、スーパーファミコン、メガドラ版は、足と階段の位置がめっちゃずれてた…。自分の中ではPCエンジン版の印象が強く残ってたんだな…。ちなみにAC版は、階段上で雑に瞬間移動してるように見えるけど、実はちゃんと足と階段の位置を合わせてあった。

[ ツッコむ ]

#2 [cg_tools] APNGの作成についてメモ

Windows10 x64 22H2上で、APNG(アニメーションPNG)画像を作る際に利用したツールをメモ。

APNGについては、以下が参考になりそう。

_Chromeの対応で活用の幅が広がりそうなアニメーション画像「APNG」についてまとめてみました | OPTPiX Labs Blog

今回は APNG_Assembler GUI (apngasm) を利用した。

_APNG Assembler

_APNG Assembler - Browse Files at SourceForge.net

_APNG アニメーション (APNG Assembler CUI版) | 東京大学 佐々木淳 研究室 沿岸環境学 海岸工学 環境水工学 水環境学

コマンドライン版、apngasm.exe でも生成できる。

APNGについては、以下が参考になりそう。

_Chromeの対応で活用の幅が広がりそうなアニメーション画像「APNG」についてまとめてみました | OPTPiX Labs Blog

今回は APNG_Assembler GUI (apngasm) を利用した。

_APNG Assembler

_APNG Assembler - Browse Files at SourceForge.net

_APNG アニメーション (APNG Assembler CUI版) | 東京大学 佐々木淳 研究室 沿岸環境学 海岸工学 環境水工学 水環境学

- apngasm_gui-2.91-bin-win32.zip か apngasm_gui-2.91-bin-win64.zip を入手して解凍。

- apngasm_gui.exe か apngasm_gui64.exe を実行。

- APNGにしたいpng画像群を、ウインドウ上にドラッグアンドドロップ。

- 再生速度その他を設定して「Make Animated PNG」をクリックすれば生成できる。

コマンドライン版、apngasm.exe でも生成できる。

apngasm output.png input*.png 1 24上記の例は、input00001.png 〜 inputXXXXX.png を output.png に変換する。最後の「1 24」は再生速度の指定。1/24 FPS、1秒間24コマで再生するように指定してる。

◎ APNG対応ビューワ :

生成した APNG を、IrfanView 4.62 32bit で表示してみたのだけど、どうも再生速度がおかしい…。Firefox上で表示したソレと比べると、再生速度が違う…。

そこで今回は、ViW 4.1 というビューワで表示確認させてもらった。ありがたや。

_ファイラ連携型画像表示器『ViW』

ViW64v41.zip を入手して解凍。ViW64.exe hoge.png といった形で呼び出す。ViW なら意図した速度で再生された。

そこで今回は、ViW 4.1 というビューワで表示確認させてもらった。ありがたや。

_ファイラ連携型画像表示器『ViW』

ViW64v41.zip を入手して解凍。ViW64.exe hoge.png といった形で呼び出す。ViW なら意図した速度で再生された。

[ ツッコむ ]

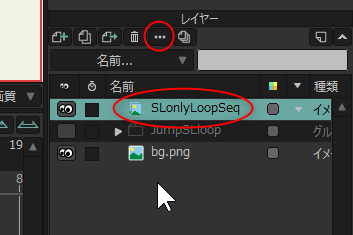

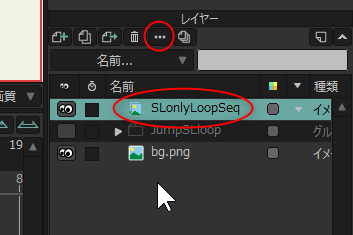

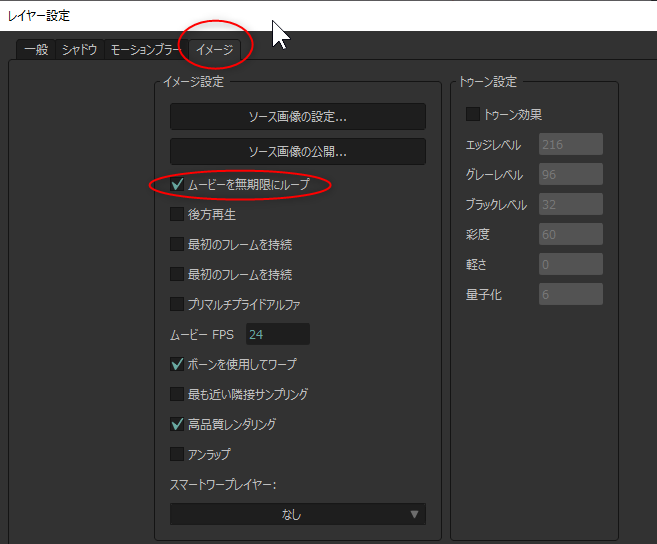

#3 [moho] Mohoで画像シーケンスをループ再生

アニメーション作成ソフト、Moho 13.5.5 で、画像シーケンスをループ再生させる方法が分からなくて悩んでしまった。

分かってしまえば簡単だった。画像シーケンスレイヤーのプロパティ? レイヤー設定? を表示して、イメージ → 「ムービーを無期限にループ」にチェックを入れるだけで良かった。

久しぶりに触ったものだから、使い方をかなり忘れてた…。

分かってしまえば簡単だった。画像シーケンスレイヤーのプロパティ? レイヤー設定? を表示して、イメージ → 「ムービーを無期限にループ」にチェックを入れるだけで良かった。

久しぶりに触ったものだから、使い方をかなり忘れてた…。

[ ツッコむ ]

2022/03/17(木) [n年前の日記]

#1 [nitijyou] 部屋を片付け

地震でアレなことになってしまった部屋の中を片付け。PCパーツの箱は紐でまとめてバラバラにならないようにしてから、滑り止めシートを敷いてその上に置いてみたり。本棚から落ちた小物類は小さい箱に入れて、箱を耐震マットで固定させたり。

積み重ねて置いてあったHDDが地震で崩れて転がりまくったのがアレなので何かに入れて保管しておきたいものだけど、さて、どうしたもんか…。ダンボール工作でもしようか…。

滑り止めシートと耐震マットの予備が無くなってしまったので補充しておきたいけれど、たぶん、今はもう店頭から消滅している気がする…。店頭に並ぶのは何ヶ月後になることやら…。

積み重ねて置いてあったHDDが地震で崩れて転がりまくったのがアレなので何かに入れて保管しておきたいものだけど、さて、どうしたもんか…。ダンボール工作でもしようか…。

滑り止めシートと耐震マットの予備が無くなってしまったので補充しておきたいけれど、たぶん、今はもう店頭から消滅している気がする…。店頭に並ぶのは何ヶ月後になることやら…。

[ ツッコむ ]

2021/03/17(水) [n年前の日記]

#1 [godot] Godot EngineのVehicleBodyノードについてまだ調べてる

Godot Engine上で車の動きを作れるらしい VehicleBody ノードと VehicleWheel ノードについて調べているところ。

Godot Engine のデモプロジェクトの中に、3D Truck Town Demo というものがあって、これが VehicleBody等を使って動いているらしくて。

_3D Truck Town Demo - Godot Asset Library

インストールして、ノード構成やノードのプロパティ値(?)について眺めていたり。

Godot Engine のデモプロジェクトの中に、3D Truck Town Demo というものがあって、これが VehicleBody等を使って動いているらしくて。

_3D Truck Town Demo - Godot Asset Library

インストールして、ノード構成やノードのプロパティ値(?)について眺めていたり。

◎ 車体モデルも用意する。 :

実験するにあたって、車体に相当する3Dモデルも必要なので、blender 2.83.13 LTS を使ってモデルを用意していたり。以下のCC0モデルを利用させてもらって作業中。ありがたや。

_Vehicles Assets pt1 | OpenGameArt.org

VehicleBody等で利用する車体モデルは、車体と、各タイヤ(ホイール?)を別オブジェクトにしておかないといけないのだけど。上記のモデルは、車体もタイヤも一体化しているので、blender で開いて以下の作業をした。

_Blender 2.8 でメッシュを分割する - しっぽを追いかけて

_【Blender】Blender2.8 3Dカーソル - 3DCGニャ-Blender、ZbrushなどCGソフトの役立つ情報-

_【Blender】原点を移動させる|yugaki|note

タイヤ部分(ホイール部分)のオブジェクト名は、最後に「_wheel」をつけておくと、Godot Engine にインポートした際に、自動で VehicleWheel ノードに変換してくれるっぽい。たぶん。自信は無いけど、おそらくは。なので…。

_Vehicles Assets pt1 | OpenGameArt.org

VehicleBody等で利用する車体モデルは、車体と、各タイヤ(ホイール?)を別オブジェクトにしておかないといけないのだけど。上記のモデルは、車体もタイヤも一体化しているので、blender で開いて以下の作業をした。

- タイヤ部分を選択して、Pキーを押して、別オブジェクトに分割(分離)。

- タイヤオブジェクトの原点を、3Dカーソル等を利用して、タイヤの中心に設定し直す。原点にしたい頂点を選択 → Shift + S → カーソルを選択物に → オブジェクトモードに変更 → オブジェクト → 原点を設定 → 原点を3Dカーソルに移動。

_Blender 2.8 でメッシュを分割する - しっぽを追いかけて

_【Blender】Blender2.8 3Dカーソル - 3DCGニャ-Blender、ZbrushなどCGソフトの役立つ情報-

_【Blender】原点を移動させる|yugaki|note

タイヤ部分(ホイール部分)のオブジェクト名は、最後に「_wheel」をつけておくと、Godot Engine にインポートした際に、自動で VehicleWheel ノードに変換してくれるっぽい。たぶん。自信は無いけど、おそらくは。なので…。

- 前タイヤは、「fornt_left_wheel」「front_right_wheel」

- 後ろタイヤは、「rear_left_wheel」「rear_right_wheel」

[ ツッコむ ]

#2 [python] Python IDE Thoony と Mu を試用

VMware Player上で Raspberry Pi Desktop bustor を動かして少し触っていたのだけど。スタートメニューのプログラミングの項に、Thonny Python IDE と、Mu という項目があることに気が付いた。コレは一体何だろう。

Thonny は、Python の学習用IDEで、Mu は Python の学習用エディタらしい。

せっかくだから、それぞれちょっとだけ試用してみたり。

Thonny は、Python の学習用IDEで、Mu は Python の学習用エディタらしい。

せっかくだから、それぞれちょっとだけ試用してみたり。

◎ Thonnyを試用。 :

そのまま Raspberry PiDesktop上で試用してもいいのだけど、Thonny はWindows用のバイナリもあるらしいので、一応試しにインストールしてそちらを使ってみた。環境は Windows10 x64 20H2。

_Thonny, Python IDE for beginners

公式サイトの上のほうに、「Download version 3.3.6 for Windows Mac Linux」とあるので、「Windows」をクリック。thonny-3.3.6.exe をダウンロード後、実行してインストール。

公式サイトには、「Microsoft Edge や IE でダウンロードすると Windows Defender からウイルスと誤判定される。Firefox でダウンロードすればそうはならない」みたいなことが書いてあった。自分は Firefox を使ってるせいか、今回はウイルスと誤判定されなかった。

バイナリには Python 一式も同梱されているらしい。Thonny のインストールフォルダ以下に、Python.exe その他が入っている。別途 Python のインストールをしなくても、すぐに学習が始められる点はイイ感じ。

Thonny を起動すると、上のほうにはエディタ画面が、下のほうにIDLEっぽいウインドウが表示される。Python の言語仕様・動作に関して何か試したいときは、下のウインドウで打ち込んでやれば、その場で確認できるのは便利かもしれない。いやまあ、たしか PyScripter もそんな感じの画面構成だったので、IDEと称するアプリでは一般的な仕様かもしれないけれど。

TABキー、もしくは、Ctrl + Space で補完機能が働く。これはありがたい。

たしかに、学習用の環境としては、なかなかイイ感じかもしれない。

_Thonny, Python IDE for beginners

公式サイトの上のほうに、「Download version 3.3.6 for Windows Mac Linux」とあるので、「Windows」をクリック。thonny-3.3.6.exe をダウンロード後、実行してインストール。

公式サイトには、「Microsoft Edge や IE でダウンロードすると Windows Defender からウイルスと誤判定される。Firefox でダウンロードすればそうはならない」みたいなことが書いてあった。自分は Firefox を使ってるせいか、今回はウイルスと誤判定されなかった。

バイナリには Python 一式も同梱されているらしい。Thonny のインストールフォルダ以下に、Python.exe その他が入っている。別途 Python のインストールをしなくても、すぐに学習が始められる点はイイ感じ。

Thonny を起動すると、上のほうにはエディタ画面が、下のほうにIDLEっぽいウインドウが表示される。Python の言語仕様・動作に関して何か試したいときは、下のウインドウで打ち込んでやれば、その場で確認できるのは便利かもしれない。いやまあ、たしか PyScripter もそんな感じの画面構成だったので、IDEと称するアプリでは一般的な仕様かもしれないけれど。

TABキー、もしくは、Ctrl + Space で補完機能が働く。これはありがたい。

たしかに、学習用の環境としては、なかなかイイ感じかもしれない。

◎ Muを試用。 :

これも Windows版をダウンロードしてインストールしてみた。環境は Windows10 x64 20H2。

_Code With Mu

_Download Mu

Windows Installer 64bit版、Mu-Editor-Win64-1.1.0b2.msi をダウンロードして実行。バージョンは 1.1.0b2、らしい。

インストール場所を尋ねてこないまま、いきなりどこかにインストールされる…。一体どこにインストールされたんだか…。

どうやら、C:\Users\(アカウント名)\AppData\Local\Programs\Mu Editor\ あたりにインストールされた模様。また、このアプリも、Python 一式がインストールされるように見えた。学習用IDEやエディタは、そういう仕様が多いのだろうか。

Windwos のスタートメニューに Mu Editor という項目が増えているので、クリックして実行。初回起動時は virtualenv を使って、独自のPython環境を用意してから、エディタ画面が起動する模様。

ツールバーのアイコンが巨大、かつ、テキスト付なので、「簡単だよ」感が強くアピールされている。初心者の、Python学習への心理的ハードルを下げてくれる効果が期待できそう。

printと打ち込もうとしたら、「pr」と打った途端に、候補と引数のヘルプが表示された。この補完感覚は Microsoft の Small Basic にちょっと近い感じがする。これまた、初心者にとっては助かる仕様かもしれない。まあ、import と打っても反応しなかったところは気になるけれど…。Python関係の全単語(?)に対応してるわけではなさそう。

エディタ画面のフォントが選べないかもしれない…。フォントサイズは変えられるけれど…。

ファイルを新規作成して保存しようとすると、C:\Users\(アカウント名)\mu_code\ 以下に保存しようとしてくる。

どうも色々と不自由さを感じる。もっとも、その分、Pythonの学習に専念しやすくなるのかもしれないなと。

以下のページで、開発方針が書かれている。

_About Mu

「重要な機能以外はあえて実装しない」「複雑さはとにかく排除」等々、とにかく初心者が悩みそうな要素は無くしてある、と謳っている。たしかに、Pythonの学習用エディタとしてはイイ感じかもしれない。

さておき。C:\Users\(アカウント名)\AppData\Local\python\mu\settings.json を変更すれば設定を変更できるのかもしれない…?

_Advanced Configuration

とりあえず作成して、以下を記述してみたところ、C:\Users\(アカウント名)\mu_code\ 以外のフォルダにファイルを保存するような動作になってくれた。

このファイルに記述して、フォント変更できないかな…。

Source Code Proフォントがハードコーディングされてる、てな話があるな…。変更できないということだろうか。

_#83: Use Source Code Pro font for editors and REPL by stestagg - Pull Request #89 - mu-editor/mu - GitHub

あらゆる環境で見た目を統一したいから、という発言も目に入った。そういう理由でフォントを変更できないようにしてある、ということかもしれない。

初心者の学習用としては実にヨサゲなエディタのように思えたけれど、自分が使うかというとビミョーなのでアンインストールしておいた。Pythonスクリプトを書くなら、VSCode (Visual Studio Code) で環境を整えたほうが良さそうだし…。

_Code With Mu

_Download Mu

Windows Installer 64bit版、Mu-Editor-Win64-1.1.0b2.msi をダウンロードして実行。バージョンは 1.1.0b2、らしい。

インストール場所を尋ねてこないまま、いきなりどこかにインストールされる…。一体どこにインストールされたんだか…。

どうやら、C:\Users\(アカウント名)\AppData\Local\Programs\Mu Editor\ あたりにインストールされた模様。また、このアプリも、Python 一式がインストールされるように見えた。学習用IDEやエディタは、そういう仕様が多いのだろうか。

Windwos のスタートメニューに Mu Editor という項目が増えているので、クリックして実行。初回起動時は virtualenv を使って、独自のPython環境を用意してから、エディタ画面が起動する模様。

ツールバーのアイコンが巨大、かつ、テキスト付なので、「簡単だよ」感が強くアピールされている。初心者の、Python学習への心理的ハードルを下げてくれる効果が期待できそう。

printと打ち込もうとしたら、「pr」と打った途端に、候補と引数のヘルプが表示された。この補完感覚は Microsoft の Small Basic にちょっと近い感じがする。これまた、初心者にとっては助かる仕様かもしれない。まあ、import と打っても反応しなかったところは気になるけれど…。Python関係の全単語(?)に対応してるわけではなさそう。

エディタ画面のフォントが選べないかもしれない…。フォントサイズは変えられるけれど…。

ファイルを新規作成して保存しようとすると、C:\Users\(アカウント名)\mu_code\ 以下に保存しようとしてくる。

どうも色々と不自由さを感じる。もっとも、その分、Pythonの学習に専念しやすくなるのかもしれないなと。

以下のページで、開発方針が書かれている。

_About Mu

「重要な機能以外はあえて実装しない」「複雑さはとにかく排除」等々、とにかく初心者が悩みそうな要素は無くしてある、と謳っている。たしかに、Pythonの学習用エディタとしてはイイ感じかもしれない。

さておき。C:\Users\(アカウント名)\AppData\Local\python\mu\settings.json を変更すれば設定を変更できるのかもしれない…?

_Advanced Configuration

とりあえず作成して、以下を記述してみたところ、C:\Users\(アカウント名)\mu_code\ 以外のフォルダにファイルを保存するような動作になってくれた。

{

"workspace": "D:\\home\\USERNAME\\mu_code"

}

このファイルに記述して、フォント変更できないかな…。

Source Code Proフォントがハードコーディングされてる、てな話があるな…。変更できないということだろうか。

_#83: Use Source Code Pro font for editors and REPL by stestagg - Pull Request #89 - mu-editor/mu - GitHub

あらゆる環境で見た目を統一したいから、という発言も目に入った。そういう理由でフォントを変更できないようにしてある、ということかもしれない。

初心者の学習用としては実にヨサゲなエディタのように思えたけれど、自分が使うかというとビミョーなのでアンインストールしておいた。Pythonスクリプトを書くなら、VSCode (Visual Studio Code) で環境を整えたほうが良さそうだし…。

[ ツッコむ ]

#3 [web][neta] 中国からの攻撃が鬱陶しい

ここ数日、中国のIPアドレスから、自宅サーバに、ひっきりなしにログインを試みようとするアクセスが…。数分おきに違うIPアドレスでアクセスしてくる…。おそらくはWindowsサーバで一般的に使われるアカウント名で試してくるっぽいので、ログ監視ツール swatch を使って、その手のアクセスが来たら /etc/hosts.deny に登録する仕組みにはしているけれど。その処理が行われるたびにメールで知らせるようにしてあるので、1日に数十通の報告メールが…。

中国は、さすがにどうにかしないといかんのではないか…。いやまあ、ロシアもだけど…。ロシアのリファラーSPAMも鬱陶しいし…。アイツラにネットを使わせたらダメだ。ろくなことをしねえ。と思ったりもしたけど、犯罪者に国籍なんて関係ないか…。どこの国にもそういう輩は居るわな…。

中国は、さすがにどうにかしないといかんのではないか…。いやまあ、ロシアもだけど…。ロシアのリファラーSPAMも鬱陶しいし…。アイツラにネットを使わせたらダメだ。ろくなことをしねえ。と思ったりもしたけど、犯罪者に国籍なんて関係ないか…。どこの国にもそういう輩は居るわな…。

[ ツッコむ ]

2020/03/17(火) [n年前の日記]

#1 [python] Kivyのスクロールバー関係を勉強中

PySide2 + QML でスクロールバーを使う方法は分かったけれど、他のGUIライブラリではそのへんどうなのかなと気になってきて。例えば Kivy あたりはスクロールバーが用意されていたりするのだろうかと。てなわけで、そのあたりをググったり試したりして勉強中。

以下のページが参考になった。ありがたや。

_Kivy ScrollViewの基本 - Qiita

kvファイル(レイアウトを指定するファイル)内で、ScrollView とやらで囲んでやればいいらしい。いくつか指定が必要になるらしいけど、随分簡単なのだなあ…。

手元の環境、Windows10 x64 1909 + Python 3.7.7 64bit + Kivy 1.11.1 で試してみたけれど、すんなり動いてくれた。

それはともかく、まるでスマホのようなスクロールをするのだな…。画面の端にあたるとバウンドするあたりとか。

PCのようなスクロールバーにはならないのだろうか、と思ってググってみたら、scroll_type とやらを指定するといいようで。

_python - How can I control my Kivy scrollview by dragging the sliders? - Stack Overflow

一応、動作確認できたスクリプトも書いておく。

中ボタンドラッグでスクロールができたりしないかな…。でも、スマホ用を意識したライブラリっぽい気配もするから無理かな…。

以下のページが参考になった。ありがたや。

_Kivy ScrollViewの基本 - Qiita

kvファイル(レイアウトを指定するファイル)内で、ScrollView とやらで囲んでやればいいらしい。いくつか指定が必要になるらしいけど、随分簡単なのだなあ…。

手元の環境、Windows10 x64 1909 + Python 3.7.7 64bit + Kivy 1.11.1 で試してみたけれど、すんなり動いてくれた。

それはともかく、まるでスマホのようなスクロールをするのだな…。画面の端にあたるとバウンドするあたりとか。

PCのようなスクロールバーにはならないのだろうか、と思ってググってみたら、scroll_type とやらを指定するといいようで。

_python - How can I control my Kivy scrollview by dragging the sliders? - Stack Overflow

ScrollView:

scroll_type: ['bars', 'content']

# scroll_type: ['bars']

bar_width: 16

みたいな。'bars' を指定するとPCっぽくなるし、'content' を指定するとスマホっぽくなる模様。bar_width で、スクロールバーの太さを指定できる。一応、動作確認できたスクリプトも書いておく。

from kivy.app import App

from kivy.uix.boxlayout import BoxLayout

from kivy.uix.button import Button

from kivy.config import Config

from kivy.lang.builder import Builder

Config.set('input', 'mouse', 'mouse,disable_multitouch')

Builder.load_string('''

<MainScreen>:

BoxLayout:

size: root.size

orientation: 'vertical'

Label:

size_hint_y: 0.1

text: "Label Text"

Button:

size_hint_y: 0.1

text: "Button Text"

ScrollView:

scroll_type: ['bars', 'content']

# scroll_type: ['bars']

bar_width: 16

BoxLayout:

size_hint: None, None

size: 1280+128,720+128

orientation: 'vertical'

Image:

size_hint: 1.0, 1.0

allow_stretch: False

source: "./img2_1280x720.png"

canvas.before:

Color:

rgba: 0.3, 0.3, 0.3, 1

Rectangle:

size: self.size

pos: self.pos

''')

class MainScreen(BoxLayout):

def __init__(self, **kwargs):

super().__init__(**kwargs)

class MainApp(App):

def build(self):

return MainScreen()

if __name__ == "__main__":

MainApp().run()

1280x720 の img2_1280x720.png という画像を読み込んで表示する。画像内を左ボタンでドラッグしてもスクロールするし、スクロールバーをドラッグしてもスクロールする。中ボタンドラッグでスクロールができたりしないかな…。でも、スマホ用を意識したライブラリっぽい気配もするから無理かな…。

[ ツッコむ ]

2019/03/17(日) [n年前の日記]

#1 [gosu][ruby] gosu + opengl-bindingsを試していたり

せっかくだから、gosu + opengl の組み合わせだけではなく、gosu + opengl-bindings の組み合わせでもスクリプトが動くように修正作業をしているところ。

環境は以下。

とりあえず、以下のスクリプトは、どちらでも動くように修正できた。

_gosu_examples_mieki256/16_gosu_opengl_test1.rb

_gosu_examples_mieki256/17_gosu_opengl_test2.rb

_gosu_examples_mieki256/opengl_glut_only_test.rb

環境は以下。

- Windows10 x64 + Ruby 2.4.5 p335 mingw32 + gosu 0.14.5 + opengl 0.10.0

- Windows10 x64 + Ruby 2.5.3 p105 mingw32 + gosu 0.14.5 + opengl-bindings 1.6.8

- Ubuntu 18.04 + Ruby 2.5.1 p57 x86_64 + gosu 0.14.5 + opengl-bindings 1.6.8

とりあえず、以下のスクリプトは、どちらでも動くように修正できた。

_gosu_examples_mieki256/16_gosu_opengl_test1.rb

_gosu_examples_mieki256/17_gosu_opengl_test2.rb

_gosu_examples_mieki256/opengl_glut_only_test.rb

◎ opengl-bindingsに対応させる際の注意点。 :

opengl 用のスクリプトを、opengl-bindings に対応させる際のポイントを一応メモ。

まず、require や include の書き方が変わる。

opengl の場合。

opengl-bindings の場合。

また、glTranslate() や glRotate() も変わる。

opengl は glTranslate() や glRotate() と書けるけど。

opengl-bindings は glTranslatef() や glRotatef() と書かないといけない。

後者の書き方をすればどちらでも動くので、全部後者で統一しちゃってもいいのかもしれない。

また、opengl は配列をそのまま渡せるけれど。

opengl-bindings は、場合によっては pack() を使わないとダメらしい。

以下のやり取りで解説されてた。

_glLightfv fails - Issue #28 - vaiorabbit/ruby-opengl

ただ、試したところ、毎フレーム呼ばれる処理の中で pack() で変換していると、処理時間がかかってしまって、描画までおかしくなるようで。初期化処理等で、できるだけ事前に pack しておいて、毎フレーム呼ばれる処理の中では pack 済みのデータを指定する、といった工夫が必要になるようだなと。

まず、require や include の書き方が変わる。

opengl の場合。

# gem install opengl glu glut require 'gl' require "glu" require "glut" include Gl include Glu include Glut

opengl-bindings の場合。

# gem install opengl-bindings require 'opengl' require "glu" require "glut" OpenGL.load_lib GLU.load_lib GLUT.load_lib include OpenGL include GLU include GLUT

また、glTranslate() や glRotate() も変わる。

opengl は glTranslate() や glRotate() と書けるけど。

glTranslate(x, y, z) glRotate(angle, 0.0, 1.0, 0.0)

opengl-bindings は glTranslatef() や glRotatef() と書かないといけない。

glTranslatef(x, y, z) glRotatef(angle, 0.0, 1.0, 0.0)

後者の書き方をすればどちらでも動くので、全部後者で統一しちゃってもいいのかもしれない。

また、opengl は配列をそのまま渡せるけれど。

glLightfv(GL_LIGHT0, GL_DIFFUSE, [1.0, 1.0, 1.0, 1.0])

opengl-bindings は、場合によっては pack() を使わないとダメらしい。

glLightfv(GL_LIGHT0, GL_DIFFUSE, [1.0, 1.0, 1.0, 1.0].pack("f*"))

以下のやり取りで解説されてた。

_glLightfv fails - Issue #28 - vaiorabbit/ruby-opengl

ただ、試したところ、毎フレーム呼ばれる処理の中で pack() で変換していると、処理時間がかかってしまって、描画までおかしくなるようで。初期化処理等で、できるだけ事前に pack しておいて、毎フレーム呼ばれる処理の中では pack 済みのデータを指定する、といった工夫が必要になるようだなと。

◎ ライト設定でハマった。 :

以下のスクリプトを opengl-bindings に対応させようとして修正した際に、ライトの設定でハマったり。

_gosu_examples_mieki256/01_gosu_opengl_11.rb

_gosu_examples_mieki256/02_gosu_opengl_15.rb

スクリプトを実行するたびに、何故かオブジェクトが真っ暗になったり、明るくなったりする。動作が不定。条件が分からない。

色々ググってるうちに、なんとなく分かってきた。ライトの位置、もしくは方向を指定する際に、[x,y,z] を指定していたけど。最後に w も追加して [x,y,z,w] を指定しないと動作が不定になるっぽい。

おそらくだけど、OpenGL側は [x, y, z, w] の4つが指定されてることを前提にして動いてるのに、スクリプト側では [x, y, z] の3つしか渡してなかったから、最後の w は謎の領域から謎の値を読んで動作していたのではないかと。スクリプトを実行するたびに、謎領域のアドレスも値も変化してしまうから、明るくなったり暗くなったりしていたのかなと。

ちなみに、glLightfv(GL_LIGHT0, GL_POSITION, [x, y, z, w]) の w は、0.0 なら平行光源、それ以外なら点光源ということになってる模様。たぶん。

_光源の設定 - OpenGL de プログラミング

_OpenGL ライティング(Lighting)

_gosu_examples_mieki256/01_gosu_opengl_11.rb

_gosu_examples_mieki256/02_gosu_opengl_15.rb

スクリプトを実行するたびに、何故かオブジェクトが真っ暗になったり、明るくなったりする。動作が不定。条件が分からない。

色々ググってるうちに、なんとなく分かってきた。ライトの位置、もしくは方向を指定する際に、[x,y,z] を指定していたけど。最後に w も追加して [x,y,z,w] を指定しないと動作が不定になるっぽい。

# Light

LIGHT_POS = [1.0, 2.0, 4.0] # 位置

LIGHT_AMBIENT = [0.5, 0.5, 0.5, 1.0] # 環境光

LIGHT_DIFFUSE = [1.0, 1.0, 1.0, 1.0] # 拡散光

LIGHT_SPECULAR = [1.0, 1.0, 1.0, 1.0] # 鏡面光

LIGHT_POS_PACK = LIGHT_POS.pack("f*")

LIGHT_AMBIENT_PACK = LIGHT_AMBIENT.pack("f*")

LIGHT_DIFFUSE_PACK = LIGHT_DIFFUSE.pack("f*")

LIGHT_SPECULAR_PACK = LIGHT_SPECULAR.pack("f*")

...

# opengl-bindings

glLightfv(GL_LIGHT0, GL_AMBIENT, LIGHT_AMBIENT_PACK)

glLightfv(GL_LIGHT0, GL_DIFFUSE, LIGHT_DIFFUSE_PACK)

glLightfv(GL_LIGHT0, GL_SPECULAR, LIGHT_SPECULAR_PACK)

glLightfv(GL_LIGHT0, GL_POSITION, LIGHT_POS_PACK)

glEnable(GL_LIGHTING) # ライティングを有効化

glEnable(GL_LIGHT0) # GL_LIGHT0 を有効化

LIGHT_POS = [1.0, 2.0, 4.0] # 位置 ↓ LIGHT_POS = [1.0, 2.0, 4.0, 0.0] # 位置

おそらくだけど、OpenGL側は [x, y, z, w] の4つが指定されてることを前提にして動いてるのに、スクリプト側では [x, y, z] の3つしか渡してなかったから、最後の w は謎の領域から謎の値を読んで動作していたのではないかと。スクリプトを実行するたびに、謎領域のアドレスも値も変化してしまうから、明るくなったり暗くなったりしていたのかなと。

ちなみに、glLightfv(GL_LIGHT0, GL_POSITION, [x, y, z, w]) の w は、0.0 なら平行光源、それ以外なら点光源ということになってる模様。たぶん。

_光源の設定 - OpenGL de プログラミング

_OpenGL ライティング(Lighting)

◎ opengl-bindingsが落ちる。 :

Windows10 x64 + Ruby 2.5.3 p105 上で、以下のスクリプトを opengl-bindings で動かすと、数秒後に Segmentation fault で落ちてしまう。

_opengl_glut_only_test.rb

opengl + glu + glut で動かした場合は落ちないのだけどな。

なんでだろうな。

VMware Player 12 + Ubuntu 18.04 + Ruby 2.5.1 p57 + opengl-bindings 1.6.8 なら落ちない。Windows上でだけ落ちるということかなあ。

teapot をワイヤー表示するとすぐに落ちるけど、ソリッド表示にしたらちょっと落ちにくくなった気もした。でもまあ、結局は落ちるけど。

_opengl_glut_only_test.rb

opengl + glu + glut で動かした場合は落ちないのだけどな。

> ruby opengl_glut_only_test.rb load opengl-bindings D:/Ruby/Ruby25/lib/ruby/gems/2.5.0/gems/opengl-bindings-1.6.8/lib/glut.rb:421: [BUG] Segmentation fault ruby 2.5.3p105 (2018-10-18 revision 65156) [i386-mingw32] -- Control frame information ----------------------------------------------- c:0004 p:---- s:0016 e:000015 CFUNC :call c:0003 p:0021 s:0012 e:000011 METHOD D:/Ruby/Ruby25/lib/ruby/gems/2.5.0/gems/opengl-bindings-1.6.8/lib/ glut.rb:421 c:0002 p:0393 s:0006 e:000005 EVAL opengl_glut_only_test.rb:154 [FINISH] c:0001 p:0000 s:0003 E:000100 (none) [FINISH] -- Ruby level backtrace information ---------------------------------------- opengl_glut_only_test.rb:154:in `<main>' D:/Ruby/Ruby25/lib/ruby/gems/2.5.0/gems/opengl-bindings-1.6.8/lib/glut.rb:421:in `glutMainLoop' D:/Ruby/Ruby25/lib/ruby/gems/2.5.0/gems/opengl-bindings-1.6.8/lib/glut.rb:421:in `call' -- C level backtrace information ------------------------------------------- C:\WINDOWS\SYSTEM32\ntdll.dll(ZwWaitForSingleObject+0xc) [0x7796a8fc] C:\WINDOWS\System32\KERNELBASE.dll(WaitForSingleObject+0x12) [0x76d445f2] C:\Ruby\Ruby25\bin\msvcrt-ruby250.dll(rb_print_backtrace+0x40) [0x62a8b220] C:\WINDOWS\SYSTEM32\ntdll.dll(RtlCaptureStackContext+0x1e521) [0x7799da71] -- Other runtime information ----------------------------------------------- ..._全エラーメッセージ - error.txt

なんでだろうな。

VMware Player 12 + Ubuntu 18.04 + Ruby 2.5.1 p57 + opengl-bindings 1.6.8 なら落ちない。Windows上でだけ落ちるということかなあ。

teapot をワイヤー表示するとすぐに落ちるけど、ソリッド表示にしたらちょっと落ちにくくなった気もした。でもまあ、結局は落ちるけど。

[ ツッコむ ]

2018/03/17(土) [n年前の日記]

#1 [ruby][mruby] Cで書いたプログラムからmrubyを呼び出せるか実験その2

Windows10 x64 + MSYS2 上で、Cで書いたプログラムに mruby 1.4.0 を組み込んで動かせるか実験。

昨日は、ただ単に組み込んでビルドできるか試したけれど、今回はCで書いたクラスを mrubyスクリプトから呼び出せるか試してみた。

以下の記事を参考にして作業。

_mruby で C 言語の構造体をラップしたオブジェクトを作る正しい方法 - Qiita

_手探りでおぼえるmruby その1:クラスを定義する、メソッドを定義する - エンジニアのソフトウェア的愛情

昨日は、ただ単に組み込んでビルドできるか試したけれど、今回はCで書いたクラスを mrubyスクリプトから呼び出せるか試してみた。

以下の記事を参考にして作業。

_mruby で C 言語の構造体をラップしたオブジェクトを作る正しい方法 - Qiita

_手探りでおぼえるmruby その1:クラスを定義する、メソッドを定義する - エンジニアのソフトウェア的愛情

◎ ディレクトリ構成。 :

以下のような構成で作業。

~/prg

|

+---- mruby

|

+---- classmruby

|

+---- mruby

◎ 名前が変わっている部分があるらしい。 :

mruby 1.4.0 では、タイプや名前が変わってるものがいくつかある模様。

- RClass → struct RClass

- ARGS_NONE() → MRB_ARGS_NONE()

- ARGS_REQ(1) → MRB_ARGS_REQ(1)

◎ 実験に使ったソース。 :

以下のような .c、.rb、Makefile になった。前述の解説ページの写経状態だけど…。

_classmruby.c

_main.rb

_Makefile

make でビルド。./classmruby.exe で実行。

mrubyスクリプト側でクラスを生成して、値を読んだり、値を設定したり等ができることが確認できた。

_classmruby.c

#include <stdio.h>

#include <errno.h>

#include <mruby.h>

#include <mruby/compile.h>

#include <mruby/proc.h>

#include <mruby/class.h>

#include <mruby/data.h>

#include <mruby/variable.h>

#include <mruby/string.h>

struct my_class

{

int num;

FILE *fp;

};

static void mrb_my_class_free(mrb_state *mrb, void *ptr);

// const static struct mrb_data_type mrb_my_class_type = {"MyClass", mrb_free};

const static struct mrb_data_type mrb_my_class_type = {"MyClass", mrb_my_class_free};

// class method

mrb_value mrb_my_class_initialize(mrb_state *mrb, mrb_value self)

{

FILE *fp;

struct my_class *h;

mrb_value path;

char *cpath;

h = (struct my_class *)mrb_malloc(mrb, sizeof(struct my_class));

h->fp = NULL;

DATA_TYPE(self) = &mrb_my_class_type;

DATA_PTR(self) = h;

mrb_get_args(mrb, "S", &path);

cpath = mrb_str_to_cstr(mrb, path);

fp = fopen(cpath, "r");

if (fp == NULL)

{

if (errno == EMFILE || errno == ENFILE)

{

mrb_full_gc(mrb);

fp = fopen(cpath, "r");

}

if (fp == NULL)

{

mrb_raisef(mrb, E_ARGUMENT_ERROR, "Cannot open file: %s", path);

}

}

h->num = 1234;

h->fp = fp;

return self;

}

mrb_value mrb_my_class_get(mrb_state *mrb, mrb_value self)

{

struct my_class *h = DATA_PTR(self);

return mrb_fixnum_value(h->num);

}

mrb_value mrb_my_class_put(mrb_state *mrb, mrb_value self)

{

struct my_class *h = DATA_PTR(self);

mrb_int num;

mrb_get_args(mrb, "i", &num);

h->num = num;

return mrb_fixnum_value(num);

}

mrb_value mrb_my_class_read(mrb_state *mrb, mrb_value self)

{

struct my_class *h;

size_t n;

char buf[1024];

h = DATA_PTR(self);

n = fread(buf, 1, sizeof(buf), h->fp);

if (n == 0)

{

mrb_raise(mrb, E_ARGUMENT_ERROR, "fread(3) returns 0");

}

return mrb_str_new(mrb, buf, n);

}

static void mrb_my_class_free(mrb_state *mrb, void *ptr)

{

struct my_class *h = ptr;

if (h->fp != NULL)

{

fclose(h->fp);

h->fp = NULL;

}

mrb_free(mrb, h);

}

int main(int argc, char *argv[])

{

// open mruby state

mrb_state *mrb = mrb_open();

if (mrb == 0)

{

printf("cannot open mruby state.\n");

return -2;

}

// define mruby class

struct RClass *my_class;

my_class = mrb_define_class(mrb, "MyClass", mrb->object_class);

MRB_SET_INSTANCE_TT(my_class, MRB_TT_DATA);

// define method

mrb_define_method(mrb, my_class, "initialize",

mrb_my_class_initialize, MRB_ARGS_NONE());

mrb_define_method(mrb, my_class, "get",

mrb_my_class_get, MRB_ARGS_NONE());

mrb_define_method(mrb, my_class, "put",

mrb_my_class_put, MRB_ARGS_REQ(1));

mrb_define_method(mrb, my_class, "read",

mrb_my_class_read, MRB_ARGS_NONE());

// file open

FILE *fp = fopen("main.rb", "r");

// run mruby script

mrb_load_file(mrb, fp);

// file close

fclose(fp);

// close mruby state

mrb_close(mrb);

return 0;

}

関係がありそうな関数をメモすると…。

- mrb_define_class() でクラスを定義。struct RClass * が返ってくる。

- mrb_define_method() でクラスメソッドを定義。

- MRB_ARGS_NONE() は引数が無いことを指定。

- MRB_ARGS_REQ(n) で引数の個数を指定。

- const static struct mrb_data_type mrb_my_class_type = {"MyClass", mrb_my_class_free}; で、クラスのインスタンスを解放する時に呼ばれる関数を指定。

_main.rb

a = MyClass.new("main.rb")

p a.get

a.put(3)

p a.get

puts

p a.object_id

p a.nil?

puts

p a.read

やってることは…。

- C側で書いたクラスを、パラメータを渡しながら生成。

- クラスが持ってる変数の値を読む。

- クラスが持ってる変数に値を設定。

- クラスのオブジェクトIDを取得。

- クラスが nil かどうか調べる。

- ファイルを読んで返すメソッドを呼ぶ。

_Makefile

TARGETS = classmruby all: $(TARGETS) SDL_PREFIX = /mingw32 # SDL_PREFIX = /mingw MRB_HEAD = ../mruby/include MRB_LIBS = ../mruby/build/host/lib # CG_LIBS = CROSS_COMPILE = $(SDL_PREFIX)/bin/ CC = $(CROSS_COMPILE)gcc CXX = $(CROSS_COMPILE)g++ CFLAGS = -g -Wall -I$(MRB_HEAD) CXXFLAGS = -g -Wall -I$(MRB_HEAD) LIBS = -L$(MRB_LIBS) -lmruby -lpthread -lm LDFLAGS = -Wl,-rpath -static -static-libgcc -static-libstdc++ clean: rm -f *.o *.a *~ $(TARGETS) $(TARGETS): $(TARGETS).o $(CXX) -o $@ $^ $(LIBS) $(LDFLAGS)

- -static をつけて、スタティックリンクをしてる。

make でビルド。./classmruby.exe で実行。

$ make /mingw32/bin/gcc -g -Wall -I../mruby/include -c -o classmruby.o classmruby.c /mingw32/bin/g++ -o classmruby classmruby.o -L../mruby/build/host/lib -lmruby -lpthread -lm -Wl,-rpath -static -static-libgcc -static-libstdc++ $ ./classmruby.exe 1234 3 48457229 false "a = MyClass.new(\"main.rb\")\np a.get\na.put(3)\np a.get\nputs\np a.object_id\np a.nil?\nputs\np a.read\n"

mrubyスクリプト側でクラスを生成して、値を読んだり、値を設定したり等ができることが確認できた。

◎ Makefileについて。 :

Makefile内で使われている特殊変数についてよく分からなかったのでググったり。

_Makefile の特殊変数の一覧

_Makefile の書き方 (C 言語) ・ WTOPIA v1.0 documentation

_Makefile の特殊変数の一覧

_Makefile の書き方 (C 言語) ・ WTOPIA v1.0 documentation

- $@ ... ターゲット名

- $^ ... 依存ファイルのリスト

[ ツッコむ ]

2017/03/17(金) [n年前の日記]

#1 [dxruby] DXRuby開発版のCustomRenderTarget関係を勉強中

_DXRuby開発版 1.5.21

以降は CustomRenderTarget というクラスが追加されて、ソレを使うとDXRubyでも3D描画その他ができるようになる、ということで書き方を勉強中。と言っても、開発版のzipに同梱されてるサンプルの、3Dtest.rb、spheretest.rb をコピペして弄ってる段階だけど。

ひとまず、こんな感じに。

_crt_test03.rb

しかしコレ、テクスチャの描画はどうやるんだろう。…もしかして 2Dtest.rb を参考にすればいいのだろうか。

意味も分からずにあちこちコピペしてみたら、なんだかソレっぽくなってきた。

_crt_test04.rb

最終的に各ドットの色を決めてくれる、ピクセルシェーダのソースをどう書けばいいのかチンプンカンプンなので、なんだか色がおかしいような気もするのだけど…。とりあえずテクスチャも描画できるのだなと。

OpenGL上では、u,v の v を上下反転しないと正常な描画にならなかったけど。DirectX ではテクスチャ座標の上下の向きが違うから、u,v の v を反転しないまま使えば正常に、と思ったけれど実際試してみたら OpenGL と同様に v を上下反転すると正常描画されるようで。…ホントにそうかな。自分の書いた変換スクリプトがバグってないか。怪しいな。

ひとまず、こんな感じに。

_crt_test03.rb

しかしコレ、テクスチャの描画はどうやるんだろう。…もしかして 2Dtest.rb を参考にすればいいのだろうか。

意味も分からずにあちこちコピペしてみたら、なんだかソレっぽくなってきた。

_crt_test04.rb

最終的に各ドットの色を決めてくれる、ピクセルシェーダのソースをどう書けばいいのかチンプンカンプンなので、なんだか色がおかしいような気もするのだけど…。とりあえずテクスチャも描画できるのだなと。

OpenGL上では、u,v の v を上下反転しないと正常な描画にならなかったけど。DirectX ではテクスチャ座標の上下の向きが違うから、u,v の v を反転しないまま使えば正常に、と思ったけれど実際試してみたら OpenGL と同様に v を上下反転すると正常描画されるようで。…ホントにそうかな。自分の書いた変換スクリプトがバグってないか。怪しいな。

◎ tinywavefrontobj.rbを更新。 :

先日作成した tinywavefrontobj.rb を使って、Wavefront形式(.obj)の3Dモデルデータファイルを、実験用モデルデータへと変換出力しようとしたのだけど。

調べてみたら OpenGL と DirectX は座標系からして違うようで。OpenGLは +z が手前だけど、DirectX は +z が奥らしい。なので、OpenGL用に書いた件のスクリプトは、そのままでは使えなくて。

_OpenGLの座標系

また、現状の CustomRenderTarget、というか VertexBuffer は、頂点インデックス配列を使わないらしい。DXRuby開発版の readme.txt にはそのように書いてある、ように見えた。

ということで、tinywavefrontobj.rb に、いくつかオプションを追加して、DXRubyから使えるデータにも変換できるように修正。

_mieki256/tinywavefrontobj

とりあえずだけど、DXRuby で使えるデータを出力したいなら、--no-index --zflip --color --hexcolor オプションをつければなんとかなる、かなと…。

jsonファイルにしておけば、Rubyスクリプト側では以下のように書いて読み込める。

ところで、色の並びは 0xAARRGGBB でいいのかしらん。DirectX はそのへんどうなってるのかググってもよく分からなかったのだけど、0xRRGGBBAA とか 0xAABBGGRR もあるのだろうか…。

調べてみたら OpenGL と DirectX は座標系からして違うようで。OpenGLは +z が手前だけど、DirectX は +z が奥らしい。なので、OpenGL用に書いた件のスクリプトは、そのままでは使えなくて。

_OpenGLの座標系

また、現状の CustomRenderTarget、というか VertexBuffer は、頂点インデックス配列を使わないらしい。DXRuby開発版の readme.txt にはそのように書いてある、ように見えた。

■4-7. VertexBufferクラス

(中略) このバージョンではIndexBufferは用意されていません。

ということで、tinywavefrontobj.rb に、いくつかオプションを追加して、DXRubyから使えるデータにも変換できるように修正。

_mieki256/tinywavefrontobj

とりあえずだけど、DXRuby で使えるデータを出力したいなら、--no-index --zflip --color --hexcolor オプションをつければなんとかなる、かなと…。

ruby tinywavefrontobj.rb sample.obj --no-index --zflip --color --hexcolor --json > sample.jsonオプションの効果は以下。

- --no-index : 頂点インデックス配列をつけない。

- --zflip : z値を反転。OpenGLとDirectXはz軸の向きが逆、らしいので。

- --color : 頂点カラー配列も出力する。とりあえず、Wavefront形式(.obj)ファイル内の、マテリアル(材質設定)のdiffuse色を、頂点カラーとして代用。

- --hexcolor : 色を 0xAARRGGBB の形で出力。

jsonファイルにしておけば、Rubyスクリプト側では以下のように書いて読み込める。

require 'json'

...

vertex_array = nil

normal_array = nil

uv_array = nil

color_array = nil

File.open("sample.json") { |file|

hash = JSON.load(file)

vertex_array = hash["vertex"] # 頂点配列

normal_array = hash["normal"] # 法線配列

uv_array = hash["uv"] # uv配列

color_array = hash["color"] # 頂点カラー配列

}

ところで、色の並びは 0xAARRGGBB でいいのかしらん。DirectX はそのへんどうなってるのかググってもよく分からなかったのだけど、0xRRGGBBAA とか 0xAABBGGRR もあるのだろうか…。

◎ Matrixクラスで少し悩んだり。 :

_RubyのMatrixクラス

の中に look_at() なんてメソッドは見当たらないのに、サンプルは動いているぞ、どういうことだ? などと悩んでしまったりして。

コレ、DXRuby開発版自体に、Matrix という名前のクラスが含まれていたのですな…。考えてみたら、DXRubyのサンプル側では require 'matrix' が書かれていないから、Ruby標準添付ライブラリの Matrix じゃなくて DXRuby が持ってる Matrix が使われるのだな…。

_3度目のVectorとMatrix - mirichiの日記

_[Ruby][DXRuby] DXRuby ユーザのための 標準添付ライブラリの紹介(前編) - あおたくノート

DXRuby側の Matrix はゲーム用に特化したものらしい、とメモ。更に、Ruby標準添付ライブラリには、 _Vectorクラス もあるのですな。これも DXRuby側で独自のクラスを持っている、と…。

しかし、たしかにコレ、ちとハマりそうな気がする…。クラス名をビミョーに変える等は難しいのだろうか…。いや、難しいからこうなってるのだろうけど。

コレ、DXRuby開発版自体に、Matrix という名前のクラスが含まれていたのですな…。考えてみたら、DXRubyのサンプル側では require 'matrix' が書かれていないから、Ruby標準添付ライブラリの Matrix じゃなくて DXRuby が持ってる Matrix が使われるのだな…。

_3度目のVectorとMatrix - mirichiの日記

_[Ruby][DXRuby] DXRuby ユーザのための 標準添付ライブラリの紹介(前編) - あおたくノート

DXRuby側の Matrix はゲーム用に特化したものらしい、とメモ。更に、Ruby標準添付ライブラリには、 _Vectorクラス もあるのですな。これも DXRuby側で独自のクラスを持っている、と…。

しかし、たしかにコレ、ちとハマりそうな気がする…。クラス名をビミョーに変える等は難しいのだろうか…。いや、難しいからこうなってるのだろうけど。

◎ 参考ページ。 :

[ ツッコむ ]

2016/03/17(木) [n年前の日記]

#1 [prog] Processingで一本道の道路の生成をテスト

DXRubyを使って、2Dで一本道を生成するのはソレっぽくできたので、今度は Processing を使って3Dで一本道を生成してみたり。環境は Windows10 x64 + Processing 3.0.2。

_sketch_roadmake1 (Processing.js版)

ソース : _sketch_roadmake1.pde

使用画像 : _road_tex.png

Windows版の実行バイナリも含めた一式 : _sketch_roadmake1_20160317.zip (72.4MB)

License は CC0 / PublicDomain ってことで。

気になる点をメモ。

さておき、道路脇の地面、ビルボードの樹木、背景等を入れれば、もう少しそれっぽくなりそうかなと。そのためには、道路のポリゴンだけではなく、地面やビルボードのポリゴン座標もデータとして持たせないと。データの持ち方・作り方を変更しないといかんなと。

ググっていたら、Processing なら透視変換行列を加工してビルボードができるけど、Processing.js では行列を取り出す命令が実装されてないから無理、という話を見かけた。なかなか厳しい。

_sketch_roadmake1 (Processing.js版)

ソース : _sketch_roadmake1.pde

使用画像 : _road_tex.png

Windows版の実行バイナリも含めた一式 : _sketch_roadmake1_20160317.zip (72.4MB)

License は CC0 / PublicDomain ってことで。

気になる点をメモ。

- そのままではテクスチャが歪むかなと思ったけど、意外と気にならない結果に。横に長いポリゴンを置いてるせいかもしれない。

- Processing.js (JavaScript) で動かすと、テクスチャがボケボケになる。なんでや。ブラウザによって見え方が違うのかと思って、Firefox、GoogleChrome で試してみたけど、やっぱりボケボケ。Java版で動かすとクッキリしてるのだけどなあ…。謎。

- 高さも変化するようにしてみたけど、ところどころガクガクしちゃってる。一応、イージングを使って多少は緩和してみたつもりだったのだけど、効果が出てないような。自分の書いたソースにバグがあるのかもしれず。それとも、スプライン補間等を使わないとダメかな。

- 道路片の裏が見えてる時は非表示にしたい。ポリゴンの法線ベクトルと視線ベクトルの内積で、とかやるんだっけ? どうだったかな。

- translate() と rotate?() で動かせないかと試したけれど上手くいかず、結局 camera() を設定して動かしてしまった。

さておき、道路脇の地面、ビルボードの樹木、背景等を入れれば、もう少しそれっぽくなりそうかなと。そのためには、道路のポリゴンだけではなく、地面やビルボードのポリゴン座標もデータとして持たせないと。データの持ち方・作り方を変更しないといかんなと。

ググっていたら、Processing なら透視変換行列を加工してビルボードができるけど、Processing.js では行列を取り出す命令が実装されてないから無理、という話を見かけた。なかなか厳しい。

◎ Processingのスクリーンショットについて。 :

普段使ってる Screenpresso で、Processing のスクリーンショットを撮ったら、

_なんだかおかしな画像

に。別のツールを使わないとダメか…。

Shotty という、DirectX使用アプリのスクリーンショットを撮れるツールを使ってみたけど、真っ白な画面になった。DXRuby の画面だったら、コレでイケるのだけどな…。

WinShot を使ったらキャプチャできた。これでいいか…。ウインドウの枠外まで少し余分に撮れちゃうのが気になるけれど、このあたりはWindows10の問題なんだろう。スグレモ撮画ツール Ver.4 も同じ状態になったし。

Shotty という、DirectX使用アプリのスクリーンショットを撮れるツールを使ってみたけど、真っ白な画面になった。DXRuby の画面だったら、コレでイケるのだけどな…。

WinShot を使ったらキャプチャできた。これでいいか…。ウインドウの枠外まで少し余分に撮れちゃうのが気になるけれど、このあたりはWindows10の問題なんだろう。スグレモ撮画ツール Ver.4 も同じ状態になったし。

[ ツッコむ ]

#2 [prog] シームレス画像ってどうやって作るんだろう

Processingで何かしらを書いてる際、テクスチャ画像ファイルを別途読み込ませて使っているのがなんだかアレだなと思えてきて。せっかくProcessing を使ってるのだから、ここはテクスチャ画像まで生成できたらグッドだろう、そうなればソースだけ置いとくだけで済むよな、と。

てなわけで、道路テクスチャを生成できないか試していたのだけど、シームレス画像にするところで悩んでしまったり。普段 _GIMPでシームレス画像は作ってる けど、どういう処理をすればシームレス画像になるんだろう…。

ググってみたけど、出てくるのは画像処理ソフトを使ったシームレス画像の作り方ばかり。プログラムで生成するやり方については、ほとんど情報がなく。あるとしても、画像を解析して特徴を云々、的な研究室でやってそうな難しい論文だったり。

GIMPのソレは、縦横半分ずつずらしてることは分るけど、そこからどういう合成をしてるのかちょっとよくわからないな…。

てなわけで、道路テクスチャを生成できないか試していたのだけど、シームレス画像にするところで悩んでしまったり。普段 _GIMPでシームレス画像は作ってる けど、どういう処理をすればシームレス画像になるんだろう…。

ググってみたけど、出てくるのは画像処理ソフトを使ったシームレス画像の作り方ばかり。プログラムで生成するやり方については、ほとんど情報がなく。あるとしても、画像を解析して特徴を云々、的な研究室でやってそうな難しい論文だったり。

GIMPのソレは、縦横半分ずつずらしてることは分るけど、そこからどういう合成をしてるのかちょっとよくわからないな…。

[ ツッコむ ]

2015/03/17(火) [n年前の日記]

#1 [pc] Atomエディタを再インストール

Atomエディタの紹介記事を眺めているうちに最新版を入れてみたくなったので再インストール。今までは

_Chocolatey

経由でインストールしてたのだけど、現在は

_インストーラがある

みたいなので、chocolatey のソレをアンインストール後、インストーラ版でインストール。

chocolatey でのアンインストールは、管理者権限でDOS窓を開いて、

インストーラ版を実行すると、何の問い合わせもなく問答無用で C:\Users\ユーザアカウント名\AppData\Local\atom\ にインストールされた。

メニューの日本語化をしてみようとして、 _Localization というパッケージをインストールしてみたのだけど、日本語化ができず。本来なら Packages メニューの中に Localization という項目が増えるはずなのだけど…。ググってみたら、 _最新版の Atom 上では動かない らしい。メニューを指定する部分が合ってない、と書いてあるように見える。

chocolatey でのアンインストールは、管理者権限でDOS窓を開いて、

choco list -localonlyでインストール済みのアプリを確認してから、

choco uninstall atomでアンインストール、だったかな。たぶん。たしかそのはず。

インストーラ版を実行すると、何の問い合わせもなく問答無用で C:\Users\ユーザアカウント名\AppData\Local\atom\ にインストールされた。

メニューの日本語化をしてみようとして、 _Localization というパッケージをインストールしてみたのだけど、日本語化ができず。本来なら Packages メニューの中に Localization という項目が増えるはずなのだけど…。ググってみたら、 _最新版の Atom 上では動かない らしい。メニューを指定する部分が合ってない、と書いてあるように見える。

[ ツッコむ ]

#2 [zatta][neta] 高音質microSDと御守り

SONYの高音質microSDの記事を眺めてるうちになんとなくバカ妄想。以下のような記事を誰か書かないものかなと…。

誰かそういう記事を書かないかものか。今ならまだ少しはアクセス数を稼げるんじゃないか。や、「お前が書け」って言われそうだけどメンドクサイです。遠慮します。

昔だったらテキストサイト系でそういう記事が書かれてそうだなと思えてきたり。今はどうなんだろ。DPZぐらいしかこういうのを書かない印象。ブロガーと呼ばれる人達は、なんかオシャレでカッコイイ記事しか書かないし。

ニコ動にレポート動画をアップするのもアリなのかな。MP3プレイヤーに御守りを貼った時と貼ってない時の両方の音を流して「この違い。お分かりいただけるだろうか」と。「わかんねえよ」とコメントがつくのか、「たしかに違う」「なんと瑞々しい」「涙が出てきた。これは良い音だ」系のコメントがつくのか…予測がつかないや。

- 「SONYの高音質microSDが気になる。しかし高い」「そこで、別のアプローチで高音質を目指したい」「こんなアイテムを買ってきた」

- 写真をババーン。交通安全の御守り。

- どうして交通安全の御守りか。電気信号は導体と言う道路の上を電子と言う車が走っているものと考えることもできる。よって交通安全の御守りは電子一粒一粒の衝突を減らしスムーズな流れにしてくれるだろう。これで音質に変化が出てこないわけがない。てな、トンデモを。

- 御守りが一種類では検証作業として心許ない。そこで更にアイテムを購入。

- 写真ババーン。安産の御守り。

- 音を産み出す部分に安産の御守りを貼り付ければ、滞りなく音が生まれてくれるはずだ。ひっかかりを感じないまろやかな音になるだろう。

- そんな調子で、お札、謎の仏像、イワシの頭も揃えて、それぞれにトンデモインチキ論を捻り出して付加。

- さて、効果のほどは。

- 音の評価項目として「音の渋滞感」「音のひっかかり」「音の神々しさ」「音の仏教感」「音の大海原感」を用意してグラフ化。

- A案。実に白々しく「予想通り音が変わった」「SONYの高音質microSDと比べて圧倒的にコストパフォーマンスが高い。オススメ」。ネタだと分かりやすい文章を書けるかどうかが難しそう。

- B案。「実験は失敗。音の違いが分からない」「オーディオの世界は深い。素人考えでは歯が立たない」「高音質を発見したSONYスゴイ」で終わる。

- C案。「困ったことになった。『変わるわけないだろ』と思っていたのに、明らかに音が違う。嘘だろ…どういうことだよ…」。そこから、プラシーボ効果を紹介したり、認知心理学の事例だの○○バイアスの話を紹介したりして、人間の感覚がいかにテキトーでいいかげんでぞんざいで当てにならないかを少し真面目に説明して、「思い込み」を持つことの危険性を説く。

誰かそういう記事を書かないかものか。今ならまだ少しはアクセス数を稼げるんじゃないか。や、「お前が書け」って言われそうだけどメンドクサイです。遠慮します。

昔だったらテキストサイト系でそういう記事が書かれてそうだなと思えてきたり。今はどうなんだろ。DPZぐらいしかこういうのを書かない印象。ブロガーと呼ばれる人達は、なんかオシャレでカッコイイ記事しか書かないし。

ニコ動にレポート動画をアップするのもアリなのかな。MP3プレイヤーに御守りを貼った時と貼ってない時の両方の音を流して「この違い。お分かりいただけるだろうか」と。「わかんねえよ」とコメントがつくのか、「たしかに違う」「なんと瑞々しい」「涙が出てきた。これは良い音だ」系のコメントがつくのか…予測がつかないや。

[ ツッコむ ]

#3 [nitijyou] 犬が脱走した

昼ぐらいまでは小屋に居たらしいのだけど、夕方、小屋を破壊して脱走したらしくて。親父さんが自転車で探しに行ったけど見つからず。

以前飼ってた犬は3回脱走して、1回目はどこかの家で保護されて、2回目は1週間ぐらいして戻ってきて、3回目は戻ってこなかったわけで。…今回は戻ってくるのだろうか。とりあえず、朝になったら自分も探しに行くつもり。

以前飼ってた犬は3回脱走して、1回目はどこかの家で保護されて、2回目は1週間ぐらいして戻ってきて、3回目は戻ってこなかったわけで。…今回は戻ってくるのだろうか。とりあえず、朝になったら自分も探しに行くつもり。

[ ツッコむ ]

2014/03/17(月) [n年前の日記]

#1 [cg_tools] Makehuman 1.0.0をインストール

_Makehuman | Open source tool for making 3D characters

人体モデル生成ツール Makehuman の 1.0.0 が公開されたらしいのでインストールしてみたり。環境は Windows7 x64。zipを解凍して適当なフォルダにコピーして、makehuman.exe を実行。

昔の版に比べると、サクサク操作できるようになってる…。素晴らしい…。

_MakeHuman 1.0.0 リリース! - オープンソースで無料の人体モデル生成ツール正式安定版!Win&Mac&Linux対応! | 3D人 によると、日本語訳に協力してくれる人を募集中っぽい。

人体モデル生成ツール Makehuman の 1.0.0 が公開されたらしいのでインストールしてみたり。環境は Windows7 x64。zipを解凍して適当なフォルダにコピーして、makehuman.exe を実行。

昔の版に比べると、サクサク操作できるようになってる…。素晴らしい…。

_MakeHuman 1.0.0 リリース! - オープンソースで無料の人体モデル生成ツール正式安定版!Win&Mac&Linux対応! | 3D人 によると、日本語訳に協力してくれる人を募集中っぽい。

◎ 出力モデルをblenderでインポート。 :

.mhx で保存して blender 2.69 でインポートできるか確認してみたり。

- Makehumanインストールフォルダ\blendertools\mhx_importer\ 内に、blender の addon が入ってる模様。

- blender → ファイル → ユーザー設定 → アドオン → ファイルからインストール、を選ぶ。import_scene_mhx.py を指定してインストール。チェックを入れて有効化。ユーザー設定を保存。

- ファイル → インポート → MakeHuman(.mhx) を選択。保存した .mhx を選択してインポート。

◎ 男子学生さんにオススメしたいなと。 :

とりあえず、男子中学生〜大学生さんにオススメしたいソフトだなと。裸のお姉さんを弄ってるだけでも、なんだか

ムラムラムッハーできるよ

楽しいよと。まあ、大半の学生さんは「なんじゃこりゃゲラゲラ」で終わっちゃうだろうけど。中には、「もうちょっと自分好みの顔つきにしたいな…」と思い始めて色々やってたらハマっちゃって超絶美形モデルデータを作れるスーパー3DCGモデラーさんになっちゃう人が出てくるかもしれんし。てのは冗談だけど、「PC使えばこんな遊びもできるんだな」と知っておくだけでも損はしないような気もしたり。

と思ったけど、ソレならMMDのほうが、という気もしてきた。MMDなら美少女揃いだもんな…。

と思ったけど、ソレならMMDのほうが、という気もしてきた。MMDなら美少女揃いだもんな…。

[ ツッコむ ]

#2 [digital] AndroidがクソなのかLenovoがクソなのか

寝ていたら、手持ちのAndroidタブレット端末、Lenovo IdeaPad Tablet A1 に起こされてしまって。一定間隔でバイブレーションが鳴って、うるさくて目が覚めてしまった。

どうやら、OSが落ちる→再起動→再起動失敗→再起動を延々と繰り返してたらしい。電源ボタンを1回押してスリープ?させた状態で放置しておくとこういう状態になることが多いような気がする。

Android 2.3 搭載の古くてショボイ製品なので、不具合があっても仕方ないのかもと思いつつ。こうも不具合があると Androidってボロボロだよなーという印象ばかりがどんどん強くなってあまり良い状態ではないなと。Android がクソなのか、Lenovo製品がクソなのか、それともインストールしたアプリが何か悪さをしてるのか、あるいはハードウェアレベルで不良品を掴んでしまったのか、そのへん分からんのですが。とにかくクソ。

これがPCなら、memtest86+等を動かすことで、メモリやCPUが壊れてるか確認できるし、HDDメーカのツールを使えばHDDが壊れてるか確認もできるのだけど。Android ってその手のチェック用ツールはないのだろうか…。せめて、ハードウェアが壊れてるかどうかぐらいは知りたいのだけど。しかし下手するとチェックツールを回すだけで凄い熱になって壊れちゃったりしそうだし。

まあ、所詮Lenovoだから…。

どうやら、OSが落ちる→再起動→再起動失敗→再起動を延々と繰り返してたらしい。電源ボタンを1回押してスリープ?させた状態で放置しておくとこういう状態になることが多いような気がする。

Android 2.3 搭載の古くてショボイ製品なので、不具合があっても仕方ないのかもと思いつつ。こうも不具合があると Androidってボロボロだよなーという印象ばかりがどんどん強くなってあまり良い状態ではないなと。Android がクソなのか、Lenovo製品がクソなのか、それともインストールしたアプリが何か悪さをしてるのか、あるいはハードウェアレベルで不良品を掴んでしまったのか、そのへん分からんのですが。とにかくクソ。

これがPCなら、memtest86+等を動かすことで、メモリやCPUが壊れてるか確認できるし、HDDメーカのツールを使えばHDDが壊れてるか確認もできるのだけど。Android ってその手のチェック用ツールはないのだろうか…。せめて、ハードウェアが壊れてるかどうかぐらいは知りたいのだけど。しかし下手するとチェックツールを回すだけで凄い熱になって壊れちゃったりしそうだし。

まあ、所詮Lenovoだから…。

[ ツッコむ ]

#3 [web] plalaのblogサービスが終了するらしいのだけど

_Broach(ブログ)サービス終了について|2014年のお知らせ一覧|ぷらら

「これからはblogですよ!」と猫も杓子もblogサービスを提供し始めた当時を思い返すと、なんだか寂しい感じもしてきたり。あの騒ぎは何だったのだろう。

plalaのblogサービスには、なんだかもやもやしていて。plalaでやってるWebサイト公開サービスのほうは、最高でも容量100MBしかないのに、blogサービスのほうは最初から容量1GB。blogサービスに比べたら、静的ページを公開するサーバのほうが負荷は低いんだから、そっちもついでに増やしてよ…。まあ、一度構築してしまったシステムに手を加えるのは危ないとか、そんなところをパワーアップしても集客には繋がらないとか、そういう判断があったのだろうけど。しかし、そういうアレコレの上で用意したblogサービスまで終了とは…。plalaは一体何をしたかったのか。結局、「他所がやってるからウチもやらないと」みたいなノリで始めたサービスはえてして上手く行かないよね、ってことになるのかな。

ここ最近、 _「Static Site Generator」 等に興味があって、ちょこちょこ調べてたりするのだけど。もしかすると、ローカルで動作するサイト生成ツールを活用することを前提にして、フツーのWebサイト公開サービスを拡充したほうが、単なるサイト公開にもblog公開にも両方使えて、使える範囲が広くなることで再度訴求力を…。とか思ったりもしたけどtwitterその他の海外サービスにユーザが集中してる現状を考えると、非クラウドサービス、非SNSを強化したところで…という判断になりそうだなと思えてきたり。

今は、月に100〜125円払って10GB使えるサービス等があるわけだけど。月に1,300円分も払って100MBしか使えないplalaのソレでは話にならないよな…。

というか、ユーザが何かしらを公開するソレが充実してるかどうかでプロバイダを選択、なんてノリは今ではもう考えにくいし。ソレ、ベッコアメとかISDNとかテレホタイムとか、そういう時代の感覚だよな…。

「これからはblogですよ!」と猫も杓子もblogサービスを提供し始めた当時を思い返すと、なんだか寂しい感じもしてきたり。あの騒ぎは何だったのだろう。

plalaのblogサービスには、なんだかもやもやしていて。plalaでやってるWebサイト公開サービスのほうは、最高でも容量100MBしかないのに、blogサービスのほうは最初から容量1GB。blogサービスに比べたら、静的ページを公開するサーバのほうが負荷は低いんだから、そっちもついでに増やしてよ…。まあ、一度構築してしまったシステムに手を加えるのは危ないとか、そんなところをパワーアップしても集客には繋がらないとか、そういう判断があったのだろうけど。しかし、そういうアレコレの上で用意したblogサービスまで終了とは…。plalaは一体何をしたかったのか。結局、「他所がやってるからウチもやらないと」みたいなノリで始めたサービスはえてして上手く行かないよね、ってことになるのかな。

ここ最近、 _「Static Site Generator」 等に興味があって、ちょこちょこ調べてたりするのだけど。もしかすると、ローカルで動作するサイト生成ツールを活用することを前提にして、フツーのWebサイト公開サービスを拡充したほうが、単なるサイト公開にもblog公開にも両方使えて、使える範囲が広くなることで再度訴求力を…。とか思ったりもしたけどtwitterその他の海外サービスにユーザが集中してる現状を考えると、非クラウドサービス、非SNSを強化したところで…という判断になりそうだなと思えてきたり。

今は、月に100〜125円払って10GB使えるサービス等があるわけだけど。月に1,300円分も払って100MBしか使えないplalaのソレでは話にならないよな…。

というか、ユーザが何かしらを公開するソレが充実してるかどうかでプロバイダを選択、なんてノリは今ではもう考えにくいし。ソレ、ベッコアメとかISDNとかテレホタイムとか、そういう時代の感覚だよな…。

[ ツッコむ ]

2013/03/17(日) [n年前の日記]

#1 [digital] gphoto2を使ってみた

コマンドラインでデジカメを制御・リモートコントロールできる、gphoto2 というツールを試しに使ってみた。VMWare Player を使って仮想PCを立ち上げ(?)、そこで Ubuntu Linux を動かしてテストをした。

- 環境は、Windows7 x64 + VMWare Player + Ubuntu Linux 12.04 + gphoto2。

- USB接続したデジカメは、Canon PowerShot A300。

◎ 使用例をメモ。 :

Ubuntu 上でshellを起動して、巷の記事を参考に入力。それぞれ何を指定してるのか、よく分かってないけど、一応動いてるように見える。

ヘルプ表示。

USB接続されてるデジカメを自動検出。

デジカメを撮影モードにする。

接続したデジカメの設定項目一覧を表示。

gphoto2 にはシェルモードとやらがあるそうで。そのモードにすると、コマンドだけをどんどん打ち込んでいけるので、動作確認が少し楽になる。TABキーを押せば、コマンド文字列の補完もできる。

各設定の状態確認、あるいは設定をするには、以下を使う。

set-config は、インデックス値、もしくは、値そのものを指定するらしい。

カメラ名の表示。

現在のISO値を確認。

項目名と内容についてメモ。

PowerShot A300の場合、shutterspeed は指定しても無視された。たぶん固定されてるか、別の項目値から自動で決定されてしまうのかなと。

撮影、かつ、PC側に撮影画像をDLするには、capture-image-and-download を使う。撮影すると一旦デジカメ内のカードメディアに画像が保存され、その画像をDL後、デジカメ側の画像を自動で削除してくれる模様。

撮影後、PC側に画像をダウンロードしないで、デジカメカード内に残しっぱなしにするなら、gphoto2 --capture-image でいいらしい。

デジカメカード内の画像を全取得するなら、gphoto2 --get-all-files。

露出の指定は、少しハマった。「=0」を指定したら「露出:+2」になるのかと思いきや、「露出:0」になったりして。「=0」の指定が、「露出=0にしろ」と解釈されてしまったらしい…。「=+2」を指定したら、「露出:+2」になってくれた。

ヘルプ表示。

$ gphoto2 --help $ gphoto2 --usage

USB接続されてるデジカメを自動検出。

$ gphoto2 --auto-detect 型式 ポート ---------------------------------------------------------- Canon PowerShot A300 (PTP mode) usb:002,004

デジカメを撮影モードにする。

$ gphoto2 --set-config capture=on

接続したデジカメの設定項目一覧を表示。

$ gphoto2 --list-config /main/actions/focuslock /main/actions/syncdatetime /main/settings/ownername /main/settings/capturetarget /main/settings/capture /main/status/model /main/status/firmwareversion /main/imgsettings/imagequality /main/imgsettings/imageformat /main/imgsettings/imagesize /main/imgsettings/iso /main/imgsettings/whitebalance /main/imgsettings/photoeffect /main/capturesettings/zoom /main/capturesettings/assistlight /main/capturesettings/exposurecompensation /main/capturesettings/flashmode /main/capturesettings/shootingmode /main/capturesettings/aperture /main/capturesettings/focusingpoint /main/capturesettings/shutterspeed /main/capturesettings/meteringmode /main/capturesettings/afdistance (以下略)

gphoto2 にはシェルモードとやらがあるそうで。そのモードにすると、コマンドだけをどんどん打ち込んでいけるので、動作確認が少し楽になる。TABキーを押せば、コマンド文字列の補完もできる。

$ gphoto2 --shell

gphoto2: {/home/mieki256/Pictures} /> list-config

/main/actions/focuslock

/main/actions/syncdatetime

/main/settings/ownername

(以下略)

各設定の状態確認、あるいは設定をするには、以下を使う。

| 状態確認 | get-config 項目名 |

| 設定(インデックス値か値そのものを指定) | set-config 項目名=値 |

| 設定(インデックス値を指定) | set-config-index 項目名=インデックス値 |

| 設定(値そのものを指定) | set-config-value 項目名=値 |

カメラ名の表示。

gphoto2: {/home/mieki256/Pictures} /> get-config model

Label: カメラの型式

Type: TEXT

Current: Canon PowerShot A300

現在のISO値を確認。

gphoto2: {/home/mieki256/Pictures} /> get-config iso

Label: ISO スピード

Type: RADIO

Current: 50

Choice: 0 50

Choice: 1 100

Choice: 2 200

Choice: 3 400

Choice: 4 自動

項目名と内容についてメモ。

| model | カメラの型式 |

| iso | ISO |

| exposurecompensation | 露出 |

| imageformat | 画像形式 |

| imagequality | 画像品質 |

| imagesize | 画像サイズ |

| flashmode | フラッシュモード |

| assistlight | 補助光 |

| meteringmode | 測光モード |

| focusingpoint | フォーカスの焦点 |

| photoeffect | 写真の効果 |

| zoom | ズーム |

| shutterspeed | シャッター速度 |

撮影、かつ、PC側に撮影画像をDLするには、capture-image-and-download を使う。撮影すると一旦デジカメ内のカードメディアに画像が保存され、その画像をDL後、デジカメ側の画像を自動で削除してくれる模様。

gphoto2: {/home/mieki256/Pictures} /store_00010001/DCIM/411CANON> capture-image-and-download

新しいファイルの格納場所: /store_00010001/DCIM/411CANON/IMG_1107.JPG

'IMG_1107.JPG' をフォルダ '/store_00010001/DCIM/411CANON' からダウンロード中...

ファイルを IMG_1107.JPG で保存します

カメラ内のファイル /store_00010001/DCIM/411CANON/IMG_1107.JPG の削除をしています

'IMG_1107.JPG' をフォルダ '/store_00010001/DCIM/411CANON' から削除中...

ちなみに上の事例では、「{/home/mieki256/Pictures}」がPC側のカレントディレクトリ、「/store_00010001/DCIM/411CANON」がデジカメ内メディアのカレントディレクトリを示している。撮影後、PC側に画像をダウンロードしないで、デジカメカード内に残しっぱなしにするなら、gphoto2 --capture-image でいいらしい。

デジカメカード内の画像を全取得するなら、gphoto2 --get-all-files。

露出の指定は、少しハマった。「=0」を指定したら「露出:+2」になるのかと思いきや、「露出:0」になったりして。「=0」の指定が、「露出=0にしろ」と解釈されてしまったらしい…。「=+2」を指定したら、「露出:+2」になってくれた。

gphoto2: {/home/mieki256/Pictures} /store_00010001/DCIM/411CANON> get-config exposurecompensation

Label: 露出度

Type: RADIO

Current: 0

Choice: 0 +2

Choice: 1 +1 2/3

Choice: 2 +1 1/3

Choice: 3 +1

Choice: 4 +2/3

Choice: 5 +1/3

Choice: 6 0

Choice: 7 -1/3

Choice: 8 -2/3

Choice: 9 -1

Choice: 10 -1 1/3

Choice: 11 -1 2/3

Choice: 12 -2

gphoto2: {/home/mieki256/Pictures} /store_00010001/DCIM/411CANON> set-config exposurecompensation=12

gphoto2: {/home/mieki256/Pictures} /store_00010001/DCIM/411CANON> set-config exposurecompensation=-2

gphoto2: {/home/mieki256/Pictures} /store_00010001/DCIM/411CANON> set-config exposurecompensation=+2

後になって、set-config-index 設定項目=インデックス値、を使えばよかったことに気付いたりして。

◎ 問題点。 :

時々、「デバイスがロックできない」と言われて制御できなくなった。

撮影画像にノイズが入ることにも気がついた。最初の頃の撮影画像は問題が無いけれど、時間が立つにつれ赤い点や白い点がポツポツと出始める。デジカメ側はずっと電源が入った状態になるのだけど、おそらくはそのせいで、デジカメ本体が熱を持ち、CCDに熱ノイズが発生するのではないかと想像。これは結構致命的。電源投入後に急いで作業をして、できるだけ早く電源をoffにする、といった注意が必要かもしれず。

電源on/offも制御出来たら嬉しいのだけど、そんなことはできるんだろうか? 電源on→offはともかく、電源off→onは難しそうだけど…。それができないと、熱の問題で、定点観測等にも使えない気がする。

露出を変えて3枚撮影するのに、約40秒かかった。仮に、電動雲台等を自作して全自動でパノラマ撮影するとなると、60枚ぐらい必要になるだろうから…。撮影時間だけでも単純計算で40分ぐらいかかってしまう。かなり厳しい。周りの風景がどんどん変わってしまう…。

自分が持ってる Canon PowerShot A300は、CCDが死にかけているぐらい古い機種なので、PCからリモート制御できるらしいのだけど。 _2009年以降のCanon製コンデジは制御機能が省かれている らしいので、古いデジカメじゃないと、こういう実験はできないっぽい。

$ gphoto2 --get-config flashmode

*** エラー ***

I/O ライブラリ ('デバイスをロックすることが出来ませんでした') でエラーが発生しました: 既にカメラは使用中です。

*** エラー (-60: 'デバイスをロックすることが出来ませんでした') ***

デジカメの電源を再投入すれば、受け付けるようになるのだけど。何が起きているのか、ちょっとよく分からない。何か別のアプリと制御を取り合ってる?撮影画像にノイズが入ることにも気がついた。最初の頃の撮影画像は問題が無いけれど、時間が立つにつれ赤い点や白い点がポツポツと出始める。デジカメ側はずっと電源が入った状態になるのだけど、おそらくはそのせいで、デジカメ本体が熱を持ち、CCDに熱ノイズが発生するのではないかと想像。これは結構致命的。電源投入後に急いで作業をして、できるだけ早く電源をoffにする、といった注意が必要かもしれず。

電源on/offも制御出来たら嬉しいのだけど、そんなことはできるんだろうか? 電源on→offはともかく、電源off→onは難しそうだけど…。それができないと、熱の問題で、定点観測等にも使えない気がする。

露出を変えて3枚撮影するのに、約40秒かかった。仮に、電動雲台等を自作して全自動でパノラマ撮影するとなると、60枚ぐらい必要になるだろうから…。撮影時間だけでも単純計算で40分ぐらいかかってしまう。かなり厳しい。周りの風景がどんどん変わってしまう…。

自分が持ってる Canon PowerShot A300は、CCDが死にかけているぐらい古い機種なので、PCからリモート制御できるらしいのだけど。 _2009年以降のCanon製コンデジは制御機能が省かれている らしいので、古いデジカメじゃないと、こういう実験はできないっぽい。

◎ とりあえず自動撮影はできそうだけど。 :

色々厳しい部分があるものの、Linux の入ったノートPCと、gphoto2 から制御できるデジカメを持ち歩けば、露出を変えて自動撮影、みたいなことができそうではあるなと。HDRI作成が少しは楽に…。

でも、RAW画像からHDR画像を生成、みたいな話をどこかで見かけた記憶も。それができるなら、RAW画像を取り出せるデジカメを入手して〜とかやったほうが楽なのかな…?

調べてみたら、RAWから作れるHDR画像は、「HDR風の画像」であって、HDRIではないっぽい。

そもそも今時のデジカメは、 _オートブラケット なる機能があったりするらしい。 _2011年度版 各社カメラのHDRオートブラケット撮影能力リスト を眺めた感じでは、gphoto2から露出を変えて撮影、なんてことをやるよりも、最初からオートブラケット機能を持ってるデジカメを使うほうが全然楽であろう予感も。

コンデジじゃなくて、Webカメラでこういうことはできないんだろうか。どうせPCを持ち歩いて制御するなら、Webカメラのほうが小さいし画像取得も速いのではないかと。もちろん、解像度と画質は、コンデジよりはるかに劣るだろうけど…。

でも、RAW画像からHDR画像を生成、みたいな話をどこかで見かけた記憶も。それができるなら、RAW画像を取り出せるデジカメを入手して〜とかやったほうが楽なのかな…?

調べてみたら、RAWから作れるHDR画像は、「HDR風の画像」であって、HDRIではないっぽい。

そもそも今時のデジカメは、 _オートブラケット なる機能があったりするらしい。 _2011年度版 各社カメラのHDRオートブラケット撮影能力リスト を眺めた感じでは、gphoto2から露出を変えて撮影、なんてことをやるよりも、最初からオートブラケット機能を持ってるデジカメを使うほうが全然楽であろう予感も。

コンデジじゃなくて、Webカメラでこういうことはできないんだろうか。どうせPCを持ち歩いて制御するなら、Webカメラのほうが小さいし画像取得も速いのではないかと。もちろん、解像度と画質は、コンデジよりはるかに劣るだろうけど…。

◎ テストに使ったシェルスクリプトをメモ。 :

capinit.sh。撮影前の初期化用。

caprun.sh。露出を変えて3枚撮影。

caprnd.sh。デジカメのカード内の全ファイルを取得、かつ、削除。

#!/bin/bash # 撮影モード有効化・設定初期化 echo gphoto2 on. echo -e "\n撮影モード有効化" gphoto2 --set-config capture=on gphoto2 --get-config capture echo -e "\nフラッシュ無効化" gphoto2 --set-config flashmode=0 gphoto2 --get-config flashmode echo -e "\n画像サイズ設定" gphoto2 --set-config imagesize=0 gphoto2 --get-config imagesize echo -e "\n画質設定" gphoto2 --set-config imagequality=2 gphoto2 --get-config imagequality echo -e "\nISO設定" gphoto2 --set-config iso=50 gphoto2 --get-config iso

caprun.sh。露出を変えて3枚撮影。

#!/bin/bash

# 露出を変えて撮影

START=`date +%s`

echo 露出 = 0

gphoto2 --set-config exposurecompensation=0

echo 撮影開始

gphoto2 --capture-image

# gphoto2 --capture-image-and-download

echo 露出 = -2

gphoto2 --set-config exposurecompensation=-2

echo 撮影開始

gphoto2 --capture-image

echo 露出 = +2

gphoto2 --set-config exposurecompensation=+2

echo 撮影開始

gphoto2 --capture-image

END=`date +%s`

SS=`expr ${END} - ${START}`

echo "${SS} sec."

caprnd.sh。デジカメのカード内の全ファイルを取得、かつ、削除。

#!/bin/bash # 撮影モード無効化・ファイル取得 echo -e "\n露出=0に設定" gphoto2 --set-config exposurecompensation=0 gphoto2 --get-config exposurecompensation echo -e "\n全ファイルをダウンロード" gphoto2 --get-all-files echo -e "\n撮影モード無効化" gphoto2 --set-config capture=off gphoto2 --get-config capture echo -e "\nカード内の全ファイルを一覧表示" gphoto2 -L echo -e "\nカード内の全ファイルを削除" gphoto2 --delete-all-files -R

[ ツッコむ ]

2012/03/17(土) [n年前の日記]

#1 [javascript] enchantMapEditorの使い方がわからず

DLして、Firefox上で動かしてみたものの、動いているようには見えず。一般的にこの手のエディタは、チップ画像をクリックするとそのチップが配置できるようになるものだと思うが、チップ画像をクリックしてみても配置操作に反映されず、首を捻る。

Google Chrome上で動かしてみたところ、「判定」「tab1」「tab2」の表示が現れた。それら文字列は、Firefox上では表示されていなかった。つまり、Firefox上では正常動作しないスクリプト、ということだろうか。

Google Chrome上で動かしてみても、操作がよくわからず。使い方の解説ページも見つからない。チップ画像をクリックすると表示が変わるし、配置もできるように見えてはいるが、おそらくは16x16ドット単位の1チップずつしか置けない感じで、これではあまりにも作業がシンドイ。使い方が分からない故に自分が頓珍漢な操作をしているだけなのか、それともWindows7上で動かすと動作がおかしくなるのか。Macは持っていないので、Mac上で動かすことが前提だとしたらちと困る。…正常動作してるかどうかも判断しづらいのはなかなか厳しい。

使用は諦めた。現状では、まだ使えないツールなのかもしれない。ネイティブで動作するマップエディタを探すことにする。

Google Chrome上で動かしてみたところ、「判定」「tab1」「tab2」の表示が現れた。それら文字列は、Firefox上では表示されていなかった。つまり、Firefox上では正常動作しないスクリプト、ということだろうか。

Google Chrome上で動かしてみても、操作がよくわからず。使い方の解説ページも見つからない。チップ画像をクリックすると表示が変わるし、配置もできるように見えてはいるが、おそらくは16x16ドット単位の1チップずつしか置けない感じで、これではあまりにも作業がシンドイ。使い方が分からない故に自分が頓珍漢な操作をしているだけなのか、それともWindows7上で動かすと動作がおかしくなるのか。Macは持っていないので、Mac上で動かすことが前提だとしたらちと困る。…正常動作してるかどうかも判断しづらいのはなかなか厳しい。

使用は諦めた。現状では、まだ使えないツールなのかもしれない。ネイティブで動作するマップエディタを探すことにする。

この記事へのツッコミ

[ ツッコミを読む(1) | ツッコむ ]

#2 [prog] マップエディタをいくつかインストール

_Tiled Map Editor (Tiled Qt 0.8.0)

_Platinum

_MapEditor5

_KSマップエディタ

_マップエディターQuoyle

Tiled Map Editor はポリゴンデータまで設定できるようになってた。素晴らしい…。ただ、このマップエディタ、透明部分が0番で、チップ画像が1番から割り振られてるのがちょっと面倒。

Quoyle は、境界線作成機能が便利だと思えた。用意するチップ画像の並べ方がちと複雑ではあるけれど、その分配置作業は楽になる。素晴らしい…。

enchant.js 向けにデータを作るなら、テキスト出力できるとありがたい。Tiled Map Editor は、設定を変更してcsv出力することが可能。実際はxml内にcsvデータが書かれる。また、json形式でもエクスポートができるようで。Platinum もCSV出力ができたはず。他のマップエディタは、そのあたりまだ確認していない。…この手のエディタは、何故かバイナリファイルで保存するものが多い印象があって。テキストファイルで出力できれば、後で整形等が楽になるのだけどなあ。

オブジェクト? スプライト? を自由な場所に配置する機能を持ったマップエディタがあれば、と思ったけれど、探しても見つからなかった。ただし、Tiled Map Editor は、オブジェクトレイヤーを作成することで、画像がチップサイズという制限はあれど、自由に配置することができるらしい。チップサイズを大き目にすれば、使い道があるかもしれず。

_Platinum

_MapEditor5

_KSマップエディタ

_マップエディターQuoyle

Tiled Map Editor はポリゴンデータまで設定できるようになってた。素晴らしい…。ただ、このマップエディタ、透明部分が0番で、チップ画像が1番から割り振られてるのがちょっと面倒。

Quoyle は、境界線作成機能が便利だと思えた。用意するチップ画像の並べ方がちと複雑ではあるけれど、その分配置作業は楽になる。素晴らしい…。

enchant.js 向けにデータを作るなら、テキスト出力できるとありがたい。Tiled Map Editor は、設定を変更してcsv出力することが可能。実際はxml内にcsvデータが書かれる。また、json形式でもエクスポートができるようで。Platinum もCSV出力ができたはず。他のマップエディタは、そのあたりまだ確認していない。…この手のエディタは、何故かバイナリファイルで保存するものが多い印象があって。テキストファイルで出力できれば、後で整形等が楽になるのだけどなあ。

オブジェクト? スプライト? を自由な場所に配置する機能を持ったマップエディタがあれば、と思ったけれど、探しても見つからなかった。ただし、Tiled Map Editor は、オブジェクトレイヤーを作成することで、画像がチップサイズという制限はあれど、自由に配置することができるらしい。チップサイズを大き目にすれば、使い道があるかもしれず。

[ ツッコむ ]

2011/03/17(木) [n年前の日記]

#1 [nitijyou] 余震

夜、3回ほど余震で目が覚めた。その都度体を起こして部屋内の家具が倒れそうかどうかを見回して、揺れが収まったらまた布団に潜って、みたいな感じ。

大宮に住んでいる親戚から、父に電話があったそうだけど。「3時間も停電して参った」「どうして福島は停電してないんだ」と愚痴られたらしい。

福島第一原発は、東京・関東に電力供給する施設なわけで。その施設のせいで今現在福島県民は恐怖におびえている訳で。ここだって被害は少ないけど被災地なわけで。自分の部屋は地震で壊滅状態になったわけで。須賀川市内に行けば倒壊してしまった建物が多々あるわけで。…そういう目に合っている福島県民に対して、そういうことを言いますか。

東京近辺には親戚も友人も知人も居るし、自分も東京に住んでた時期があるからアレなのだけど。あんまりだ。

大宮に住んでいる親戚から、父に電話があったそうだけど。「3時間も停電して参った」「どうして福島は停電してないんだ」と愚痴られたらしい。

福島第一原発は、東京・関東に電力供給する施設なわけで。その施設のせいで今現在福島県民は恐怖におびえている訳で。ここだって被害は少ないけど被災地なわけで。自分の部屋は地震で壊滅状態になったわけで。須賀川市内に行けば倒壊してしまった建物が多々あるわけで。…そういう目に合っている福島県民に対して、そういうことを言いますか。

東京近辺には親戚も友人も知人も居るし、自分も東京に住んでた時期があるからアレなのだけど。あんまりだ。

[ ツッコむ ]

2010/03/17(水) [n年前の日記]

#1 [prog] Small Basicをちょこちょこ触ってる状態

キーの押し下げ状態を知る方法が分からない。Windows側で設定したキーのオートリピートが反映される形での状態取得はできる。でも、ゲームの類を作る場合は、それではいかんだろうと。キャラクターが、「ツッ、ツーー」で動いちゃいかん。キーを押しっぱなしなら「ツーー」で動いてくれないと。

まだ色々と開発途中であるから仕方ないのだろうけど。日本語版のドキュメントがほとんどないのがキツイ感じ。いや、Visual Basic あたりを参考にすればどうにかなったりするのかな? わからんけど。

まだ色々と開発途中であるから仕方ないのだろうけど。日本語版のドキュメントがほとんどないのがキツイ感じ。いや、Visual Basic あたりを参考にすればどうにかなったりするのかな? わからんけど。

[ ツッコむ ]

2009/03/17(火) [n年前の日記]

#1 [python] Python+Tkinterが動かなくなっていた

いつから動かなくなっていたんだろう…。こんな状態になるなら、Python + Tkinter で関連ツールを書くんじゃなかった。blender に絡んでくるツールだから、Python を使ったほうがいいのかなとか、Tkならどこの環境にも比較的入ってる・インストール可能だから都合がいいかなとか、そのように思って使ったのがかえって裏目に出てしまったかもしれず。

Python 2.6.1 をアンインストール・再インストールしたものの、結果は変わらず。

どうも、ActiveTcl をインストールしたせい・環境変数の TK_LIBRARY に ActiveTcl のソレを指定したのが問題ではないのかと思えてきたり。なので試しに、ActiveTcl をアンインストールして、環境変数 TK_LIBRARY と TCL_LIBRARY を削除してみた。ちなみに、それぞれの環境変数は、

上記対処をしてみたところ、Python + Tkinter の helloworld スクリプトが動作した。するとやっぱり、ActiveTcl が原因だったということか。いや、TK_LIBRARY が原因なのかもしれないか。…しかし一体どこで設定したんだろう。>TK_LIBRARY。ActiveTclインストール時に自動で設定されたのかしら。そもそもどうして ActiveTcl なんぞを自分はインストールしていたのだろう。思い返してみたところ、どうも Ruby/Tk を試そうとした際にインストールしたような気がする。すると、結局はは Ruby が癌だったのか。<オイ。Ruby が自前で Tk関連ライブラリを内包していないのがマズイのだ。いやまあ、Ruby としてはそのへん何か理由があるんだろうけど。

というか、Ruby/Tk を使うために ActiveTcl をインストールして環境変数を設定したりすると、Python + Tkinter が使えなくなるというこの状況は非常にマズイ。自分が作ったスクリプトは、後々別環境で使われる可能性がありそうなのだけど、ソレを動かす環境では ActiveTcl をインストールしちゃダメ、Ruby はもちろん Ruby/Tk 使っちゃダメ、というわけにはいかないだろうと。

自分一人でスクリプトを使う分には、コマンドライン指定でも特に問題は無いけれど。他者が使う可能性がある場合は、ファイル指定等、GUIにしておいたほうが良さそうな気がする。しかし、てっとり早くGUIツールにできる Tk は、今回のようなトラブルが起きかねない。どうしたもんか…。

Python 2.6.1 をアンインストール・再インストールしたものの、結果は変わらず。

どうも、ActiveTcl をインストールしたせい・環境変数の TK_LIBRARY に ActiveTcl のソレを指定したのが問題ではないのかと思えてきたり。なので試しに、ActiveTcl をアンインストールして、環境変数 TK_LIBRARY と TCL_LIBRARY を削除してみた。ちなみに、それぞれの環境変数は、

TK_LIBRARY C:\usr\local\Tcl\lib\tk8.5

TCL_LIBRARY C:\usr\local\Tcl\lib\tcl8.5になっていたことをメモ。ActiveTcl のインストール先フォルダ内の特定フォルダを指定していたらしい。>過去の自分。

上記対処をしてみたところ、Python + Tkinter の helloworld スクリプトが動作した。するとやっぱり、ActiveTcl が原因だったということか。いや、TK_LIBRARY が原因なのかもしれないか。…しかし一体どこで設定したんだろう。>TK_LIBRARY。ActiveTclインストール時に自動で設定されたのかしら。そもそもどうして ActiveTcl なんぞを自分はインストールしていたのだろう。思い返してみたところ、どうも Ruby/Tk を試そうとした際にインストールしたような気がする。すると、結局はは Ruby が癌だったのか。<オイ。Ruby が自前で Tk関連ライブラリを内包していないのがマズイのだ。いやまあ、Ruby としてはそのへん何か理由があるんだろうけど。

というか、Ruby/Tk を使うために ActiveTcl をインストールして環境変数を設定したりすると、Python + Tkinter が使えなくなるというこの状況は非常にマズイ。自分が作ったスクリプトは、後々別環境で使われる可能性がありそうなのだけど、ソレを動かす環境では ActiveTcl をインストールしちゃダメ、Ruby はもちろん Ruby/Tk 使っちゃダメ、というわけにはいかないだろうと。

自分一人でスクリプトを使う分には、コマンドライン指定でも特に問題は無いけれど。他者が使う可能性がある場合は、ファイル指定等、GUIにしておいたほうが良さそうな気がする。しかし、てっとり早くGUIツールにできる Tk は、今回のようなトラブルが起きかねない。どうしたもんか…。

- Javaは、ソースを気軽に開いて中身を確認したり、修正したりすることができないだろうし。

- ActivePerl は Tkモジュールを同梱しなくなったからちと面倒だし。

- Ruby/Tk は別途 ActiveTcl を入れるのが面倒だし。

- Tcl/Tk は言語仕様の面でアレだし。

[ ツッコむ ]

#2 [pc] AmazonからCanon iP4600が届いた

10,880円で購入。今まで使ってた・顔料インク部分だけが微妙に印刷されなくなった iP4300 を片づけて、早速セットアップ。問題なく印刷できそうな感じ。

CD-Rへの印刷機能等がない、Canon iP3600 でもいいかなと思ってたけど。 *1 妹が「絶対に両面印刷がなきゃ嫌だ」と強く主張するので、両面印刷可能、かつ、非複合機のiP4600を選択したわけで。この機種以外に両面印刷可能な機種となると、プリンタとスキャナが一体になった、いわゆる複合機になってしまう。インクジェットプリンタは、やれヘッドの目詰まりが云々等のトラブルが必ず出てくる機器だろうけど。プリンタ部分に発生したトラブルのせいで、関係ないスキャナ機能まで一緒に修理に出さなきゃいけない or 買い替えになるのはバカバカしいので、できるだけプリンタ単体の機器を選びたいなと思っているわけで。